【やってみた】「Luma AI」で3Dスキャンしてみた!

こんにちは、「Experience×Technology(体験×技術)」の春川です。

今回は3Dスキャンアプリ「Luma AI」の体験レポートです!

ちなみに、たまたまXでこの方の投稿が流れてきて「私もやってみたい!」と思ったのがきっかけです。この動画はどうやって作られたのか……わくわくしますね!

最近スキャン映えするものを見ると、すぐに3Dスキャンする癖ついてきた😂#LumaAI #pokemon pic.twitter.com/66Vl24GdtJ

— ARおじさん / MESON CEO (@AR_Ojisan) January 13, 2024

Luma AIとは?

Luma AIは、スマホで撮影した動画から3Dモデルを作れるアプリです。

ブラウザから動画ファイルのアップロードで作成可能

スマホアプリはiOSのみ対応

写真・動画で撮れていない部分をAIが補完する「NeRF」という技術を使っているそうです。

Luma AIはNeRF(Neural Radiance Fields)という技術を使って3Dモデルを作成しています。NeRFとは簡単にいうと、複数枚の写真を用いて機械学習から三次元の状態に復元する技術のことです。Luma AIはNeRFを用いたスマートフォンからの3Dキャプションアプリの筆頭といえます。

世界中の素敵な風景を3Dで楽しめる

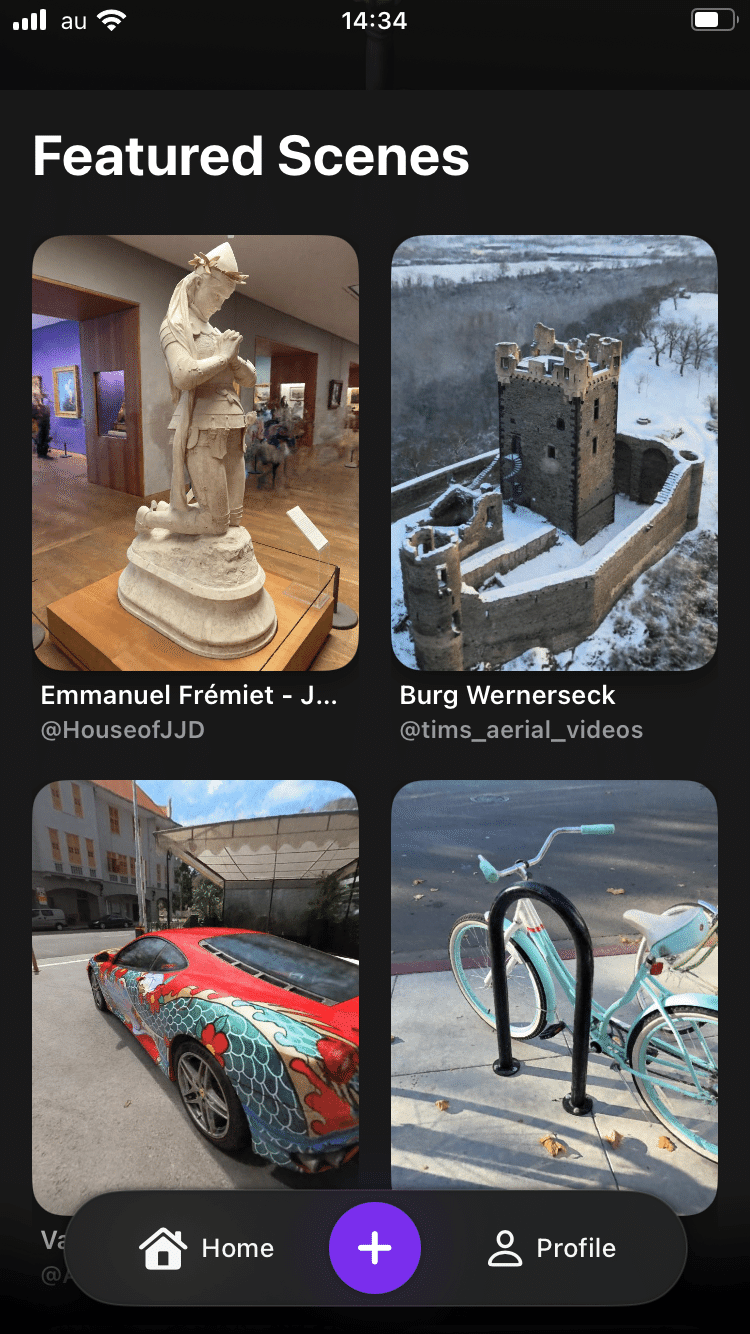

まずはiPhoneにアプリをインストールして起動してみました。

世界中の風景・オブジェなどがすでにたくさんアップされているので、1個ずつ見ているだけでも旅行気分が楽しめます!

下鴨神社

大きな建物を俯瞰してみたり、寄って見ることもできます。

ただし、ある程度までしかズームできず、テクスチャは粗めです。

パリの美術館

室内の彫刻を色々な方向から見ることもできます。

動画のアップロード方法

スマホアプリでは「+」ボタンから動画をアップします。

「OBJECT」で撮影

「OBJECT」メニューを選ぶと、カメラが起動してそのまま撮影ができるそうなのですが、私のiPhone SEは対象外でした……。残念。

以下の記事で「OBJECT」メニューでの撮影方法を紹介されていたので、ご興味ある方はご覧ください。

NERFで3Dモデルを作る「Luma AI」無料での使い方や商用利用の可否を紹介!

「UPLOAD」で動画ファイルアップ

私は「UPLOAD」メニューから動画ファイルをアップする形で試してみました。

注意点としては、なるべく360度全方向から撮影した動画を用意することです。

試しに1方向からしか撮影していない動画をアップしたところ、エラーになってしまいました。

360度の撮影はどのくらいの力量が必要なのか心配になりつつ、ひとまず試しにオフィスの椅子のまわりをぐるっと歩きながら撮影してみました。

撮影途中で椅子が画面からはみ出たりスマホが揺れてしまったりしたので、うまくいかないかも……と思いつつダメ元でアップ。

無事エラーにはならず、動画生成が開始しましたが、なかなか時間がかかりそうな気配です。

3Dモデル生成

生成が終わったら通知をしてくれるとのことなので、アプリを閉じてしばし待ちます。

しばらくしてアプリ通知がきたのでどきどきしながら見てみると……できてました!!成功です!

↓撮影した動画(特別な機材は使わず、歩いてまわりを撮影しただけ)

↓完成した3Dモデル

撮影していない部分(壁や天井など)は生成できていませんが、撮影した椅子まわりについては、かなりリアルに生成できています。

素人の撮影でもここまでしっかり再現できるとは驚きです!

おわりに

360度撮影が必要ということで、ハードルを感じていましたが、実際に試してみたところ、とてもかんたんに3Dスキャンができておもしろかったです。

撮影時に画面がぐらぐら揺れたり、多少対象物が画面から外れたりしてしまっても、AIが良い感じに補正してくれるということがわかりました。

私たちの仕事でどう使うかを考えてみると……

例えば遠方のクライアント現場(ショールーム・工場などインタラクティブコンテンツの設置現場)の様子を出張メンバーが撮影してきて、他のメンバーに3Dモデルとして共有できたらおもしろそうです。

なかなか全員で現場に伺えないので、施設の広さ・モニターやプロジェクターの位置・コンテンツがどう見えるか、などを感覚として共有できると良いかもしれません。

個人としても旅行した際の記念に、風景や建物を持ち帰るツールとしてLuma AIを活用してみたくなりました。

iPhoneユーザーの方はぜひ体験してみてくださいね!

X(旧Twitter)

このnoteとも連携して発信していくので、興味のある方はフォローよろしくお願いいたします!

今回はPC作業を革新的に変えるVR/MRアプリ『Immersed』をご紹介します。

— Experience×Technology (@Flag_ExTech) May 20, 2024

Meta Quest 3で使えるこのアプリは、仮想空間に複数のモニタを展開し、まるでSF映画のような作業環境を実現します。

実際に体験してみた感想も載せていますので、ぜひチェックしてみてくださいね!https://t.co/Dzr6Pt7wS8

Experience×Technology(体験×技術)

面白い海外事例の紹介、今までの実績を振り返りながらの裏話、個性あふれるスタッフたちによるチャレンジ企画やインタビューなど、みなさんが楽しみながらExperience×Technologyの世界に触れていただけるコンテンツを発信していきます。