「The Rise and Potential of Large Language Model Based Agents: A Survey」読んでみました。

LLMの可能性を考えてみたく、今更ながら読んでみました。他サイトでもいろんな解説あると思います。遅咲き記事ですみません。この論文は、かなりページ数あるので偏りのある内容になっていると思いますので、あしからず。

論文

「The Rise and Potential of Large Language Model Based Agents: A Survey」

[2309.07864] The Rise and Potential of Large Language Model Based Agents: A Survey (arxiv.org)

引用文献除いて48ページの大作です。引用文献数は675。すごい。

要約

AIエージェントは、環境を感知し、意思決定を行い、行動を起こす人工的なエンティティであり、この目標を達成する有望な手段とされています。しかし、既存の取り組みは主に特定の能力やタスクのパフォーマンスに焦点を当てており、多様なシナリオに適応できる一般的で強力なモデルが不足しています。ここでLLMが登場します。LLMは多様な能力を示し、AGI(Artificial General Intelligence:人工一般知能)の可能性を秘めているとされています。この論文は、LLMベースのエージェントの可能性と課題を包括的に探求したもので、今後の発展の参考としてほしい。

論文の構成

構成は以下のようになっています。

Introduction

Background

2.1 Origin of AI Agent

2.2 Technological Trends in Agent Research

2.3 Why is LLM suitable as the primary component of an Agent’s brainEnvironment Perception

Simulated Societies

Key Topics and Open Problems

5.1 Mutual Benefits of LLM and Agent Research

5.2 Evaluation Efforts and Prospects for LLM-based Agents

5.3 Potential Risks of LLM-based AgentsConclusion

Acknowledgements

References

各セクションでは、AIエージェントに関する背景や環境認識、シミュレーション社会、重要なトピックや未解決の問題、結論、謝辞、参考文献などが取り上げられています。

論文概要

きちんと書いていくと多い(既に心折れてますが、すみません。)ので、以下のトピックで書いていきます。

概念とフレームワーク:

哲学的な起源からAIの発展に至るまでのエージェントの概念の追跡。

なぜLLMがエージェントの適切な基盤となるのかの説明。

脳、知覚、行動のコンポーネントを備えたLLMベースのエージェントの一般的なフレームワーク。

LLMベースのエージェントの応用:

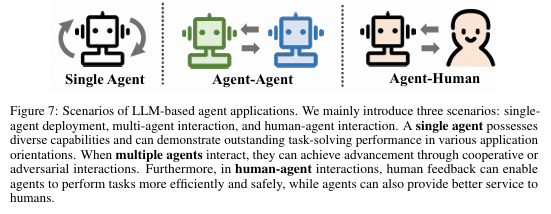

単一エージェントのシナリオ: LLMが個々の文脈でどのように機能するか。

複数エージェントのシナリオ: 複数のLLMベースのエージェントの相互作用を探求。

人間との協調: LLMが人間とどのように協調するか。

エージェント社会:

LLMベースのエージェントの行動と特徴を調査。

エージェント社会から生じる社会現象の分析。

未解決の問題と主要なトピック:

課題とさらなる研究の領域についての議論。

概念とフレームワーク

なぜLLMがエージェントの適切な基盤と考えるか?

LLMがエージェントの適切な基盤となる理由を以下のように述べています。

多様性と汎用性

LLMはトレーニングデータから多様な文脈を学習できるため、さまざまなタスクに適応でき、エージェントは様々な状況で適切に行動する必要があり、LLMはその柔軟性を持っている。

自然言語理解と生成

エージェントは自然言語を理解し、適切な応答を生成する必要があり、LLMは自然言語処理の分野で優れた成果を上げており、コミュニケーション能力を向上させるのに適している。

知識ベースと推論

LLMは大量のテキストデータから知識を獲得できます。エージェントは知識ベースを持ち、問題解決や計画など推論を行う必要があり、LLMはこれを可能としている。

エージェントの学習と進化

LLMは事前トレーニングされたモデルであり、エージェントの学習に利用できます。エージェントは環境との相互作用を通じて進化し、LLMはそのプロセスをサポートできる。

LLMはエージェントの柔軟性、コミュニケーション能力、知識ベース、学習能力を向上させるための強力な基盤となります。

LLMベースのエージェントの一般的なフレームワーク

一般的なフレームワークの例として、Chain-of-Thought(CoT)や問題分解などの手法が挙げられています。これらの手法は、LLMが推論や計画能力を持つことを活かして、エージェントが複雑な問題を解決する際に役立ちます。

具体的には、CoTは、エージェントが論理的な推論を行いながら問題を解決するための枠組みです。これにより、エージェントは複数のステップを経て問題を解決するプロセスを効果的に進めることができます。

また、問題分解は、大きな問題を複数の小さなサブ問題に分割し、それぞれを個別に解決することで全体の問題を解決する手法です。LLMが複雑な問題を理解し、適切に分解して解決する能力を持つため、この手法はLLMベースのエージェントに適しています。

これらのフレームワークを活用することで、LLMベースのエージェントは高度な推論や計画能力を発揮しながら、複雑な課題に効果的に対処することが可能となります。

LLMベースのエージェントの応用

LLMベースのエージェントが個々の行動やパーソナリティから社会性へと進化する過程や、様々な環境での振る舞いや相互作用についても詳細に議論されています。

単一エージェントのシナリオ

LLMが個々の文脈でどのように機能するか。

タスク指向のシナリオ

単一エージェントが特定のタスクを遂行する場合。例えば、自動運転車が安全かつ効率的に目的地に到達するための行動を決定するシナリオなどが挙げられてます。イノベーション志向のシナリオ

単一エージェントが新しいアイデアや解決策を生み出すために創造的な活動を行う場合。例えば、新しい製品やサービスの開発を行うためのアイデア生成プロセスなどが該当します。ライフサイクル志向のシナリオ

単一エージェントが個々のライフサイクルイベントに対応する場合。例えば、健康管理やライフプランニングなど、個人の生活に関連する様々な局面でのサポートが含まれます。

これらのシナリオでは、単一エージェントが環境や目標に応じて適切な行動を選択し、タスクを遂行する能力が求められます。また、単一エージェントが自律的に行動することで、効率的かつ効果的な結果を達成することが期待されています。

複数エージェントのシナリオ

複数のLLMベースのエージェントの相互作用を探求

協力的相互作用のシナリオ

複数のエージェントが協力して共通の目標を達成する場合。例えば、複数のロボットが協力して物品を運ぶ作業や、複数のドローンが協力して空中での任務を遂行するシナリオが挙げられます。競争的相互作用のシナリオ

複数のエージェントが競争してリソースや報酬を獲得する場合。例えば、複数のAIエージェントが競い合ってゲームをプレイするシナリオや、複数の自動車が交通状況において競争するシナリオが該当します。

これらのシナリオでは、複数のエージェントが相互に影響しあいながら行動することで、より高度なタスク遂行や問題解決が可能となります。協力的相互作用では、チームワークや連携が重要となります。一方、競争的相互作用では、効率的な戦略やリーダーシップが求められる場合もあります。

人間との協調

LLMが人間とどのように協調するか

教育分野における協調

エージェントが教育現場で教師や生徒と協力して学習支援や教育プログラムの実施を行う場合。例えば、個別の学習ニーズに合わせたカスタマイズされた教材提供や学習進捗のモニタリングなどが含まれます。医療分野における協調

エージェントが医療従事者や患者と協力して診断支援や治療計画の策定を行う場合。例えば、症例データの解析や治療法の提案などが該当します。一般的な業務における協調

エージェントがオフィス環境やサービス業界などで人間と協力して業務を遂行する場合。例えば、顧客対応や予定管理、情報提供など、様々な業務において人間との協調が重要となります。

これらのシナリオでは、エージェントが人間と協力してタスクを遂行することで、効率的かつ効果的な業務遂行が可能となります。人間とエージェントが連携し合うことで、より高度なサービスや成果を生み出すことが期待されています。

エージェント社会

エージェント社会におけるキーとなる特性やメカニズム、新たな社会現象から得られる洞察、倫理的および社会的リスクについても議論されています。エージェント社会は、エージェント同士が相互作用し合い、社会的な行動や活動を展開する枠組みを指し、人間とエージェントが共に参加する社会活動を想定したシナリオが提示されています。

LLMベースのエージェントの行動と特徴を調査

LLMベースのエージェントは、以下のような行動と特徴を持つことが示唆されています。

行動

効率的な意思決定能力: LLMを活用することで、エージェントは効率的な意思決定を行うことが可能となります。これにより、エージェントは複雑な状況下で適切な行動を選択できます。

計画と反省能力の活用: LLMを用いることで、エージェントは計画を立てたり、過去の経験を反省してより最適な行動を取ることができます。

特徴

革新性: LLMを基盤とするエージェントは革新的なアプローチを取ることができます。新たな課題に対して柔軟に対応し、新しい解決策を見つける能力があります。

タスク指向性: LLMベースのエージェントは、特定のタスクに焦点を当てて行動する傾向があります。タスクの遂行に向けて効果的な戦略を展開します。

これらの特徴と行動により、LLMベースのエージェントは多様な状況や課題に対応し、高度な意思決定や行動計画を実現することが期待されています。

エージェント社会から生じる社会現象の分析

LLMベースのエージェント社会から生じる社会現象の分析に関する情報は以下のように示唆されています。

行動と個性

外部的側面と内部的側面: エージェント社会では、個々のエージェントの外部的な行動だけでなく、内面的な要素も重要です。外部的な行動とは、エージェントが環境とどのように相互作用するかを指し、内部的な要素は認知、感情、性格などの個性を形成します。

社会行動: エージェント社会では、個々のエージェントが協力と競争が共存する環境で自発的な社会行動を示すことがあります。これらの行動が絡み合い、社会的相互作用を形成します。

社会現象の洞察

社会シミュレーション: エージェント社会では、個々のエージェントの行動や相互作用から社会現象が生じます。これにより、人間社会における洞察や理解が深まる可能性があります。

社会性の誕生: シミュレーション環境において、個々のエージェントや人間が相互作用することで社会性が生まれることが示唆されています。

エージェント社会における行動と個性、社会現象の洞察を通じて、人間社会における社会的相互作用や現象について新たな理解や洞察を得ることが期待されています。

未解決の問題と主要なトピック

以下のような未解決な問題が述べられています。

エージェントの一般化と適応性

LLMベースのエージェントは、特定のタスクに限定されず、多様なシナリオで適応できる柔軟性を持つことが求められています。しかし、この一般化と適応性をどのように実現するかは未解決の課題です。エージェントの信頼性と説明可能性

LLMはブラックボックスモデルであり、その意思決定プロセスを説明することが難しい場合があります。エージェントの信頼性と説明可能性を向上させる方法を探求する必要があります。エージェントの社会的相互作用

LLMベースのエージェント同士の相互作用において、適切なコミュニケーションや協力行動を実現するための方法が未解決です。エージェント社会における社会的ルールやノルムの設計が重要です。エージェントの倫理とバイアス

LLMはトレーニングデータから学習するため、バイアスや偏見を持ち込む可能性があります。エージェントの倫理的な振る舞いとバイアスの管理について研究が進行中です。

また、LLMを使用する際に関して以下のような課題や制約があります。

リソースと計算コスト

LLMは膨大なパラメータ数を持ち、大規模なデータセットで事前学習を行う必要があります。そのため、計算リソースやコストが高くなるという課題があります。データの偏りやバイアス

LLMは事前学習に使用されるデータに偏りやバイアスがある場合、その影響を受ける可能性があります。これにより、モデルの性能や汎化能力に影響を与える可能性があります。過学習と汎化能力

LLMは大規模なデータセットで訓練されるため、過学習のリスクが高まります。過学習が起きると、新しいデータに対する汎化能力が低下する可能性があります。解釈性と説明性

LLMは膨大なパラメータを持つため、その内部の動作や意思決定プロセスを解釈することが難しい場合があります。これにより、モデルの説明性が低下するという課題があります。倫理的な考慮事項

LLMを使用する際には、倫理的な問題や偏り、プライバシーの問題などに対処する必要があります。特に、モデルが人間の意思決定に影響を与える場合には、倫理的な配慮が必要です。

これらの課題や制約を克服するためには、適切なデータの収集と前処理、モデルの適切な評価と解釈、倫理的なガイドラインの導入などが重要です。