NeurIPS2024に参加してきました

投稿者のプロフィール

- 東大工学部四年

- NeurIPS workshopに採択されたので本会議の方も合わせて参加してきた

- 参加期間はカナダ現地時間で12/10~12/14

- 海外は8年ぶりだった

Vancouverについて

NeurIPS2024の会場となったバンクーバーはカナダの西海岸側にある都市です。カナダといえばトロント大学なのですがそちらは東の五大湖側にあるので, かなり離れている場所にあります。

時差は17時間で, 初日は公演を聴いているのか寝てるのかわからないぐらい苦しみました。

カナダは公用語が英語とフランス語なので, 空港では2つの表記がなされていました。これはかなり面白かったです。

あとマックは美味しかったです。魚と肉は何を食べてもハズレはありませんでした。

あと僕はベンチプレス100kgを挙げるほど巨漢なのですが, 朝ごはんをモリモリ食べていたらホットサンドの差し入れをもらいました。人の温かみを知ることができました。

モンスターも結構飲みました

NeurIPS2024の流れ

なんと恐ろしいことに, この2つの建物を丸ごと使って行われます。

日程

12/10: 開会式とかInvited talkとかAffinity Event, 18:30以降は懇親会もあるんですが, 万単位の人が参加するイベントなのでめちゃくちゃ混雑します

12/11~12/13: 本会議

12/14, 12/15: Workshop←自分が発表したのはここ

本会議中の1日の流れ

10時まで: Invited talkなどがある

10:00~11:00: 分野ごとにOral presentation

11:00~14:00: ポスターセッション

15:30~16:30: 分野ごとにOral presentation2

16:30~19:30: ポスターセッション2

これらが全てではなく, これらの合間に企業ブースがあったりだとか, 合間にInvited talkが挟まったりしたりだとかします。基本的に自由です。

非常に大きい学会なので一日中ポスターセッションを回っていたりすると1日が終わる頃にはクタクタです。自分は時差ボケがなかなか治らなかったこともあり, ホテルに帰ったらすぐ倒れてました。

開会式ではBest paperの表彰がされます。写真を撮り忘れたのですが, Not All Tokens Are What You Need for Pretrainingというpaperもawardを取得していたので是非みてください

Invited TalkではIlya sutskeverによるTalkも聞けました。生で見れて感動しました。

あとJeff Deanの「AI will Reshape Chip Design — Jeff Dean at NeurIPS 2024」もみてください

ポスターセッションは会場が本当に広いです。論文を見るのに夢中になっていたので会場の写真は撮れていないため, 記事を執筆中にXで適当に検索してヒットしたものを貼ってみます。

自分は今の研究分野にも関係する

1. Multimodal

2. Medical Application

3. speed-up or reduce memory footprint

の3つをテーマに主にポスターを回っていましたが, 数歩あるけば絶対にテーマにヒットする論文があり, それを真面目に見て質問していたら気がついたら4時間は経っていました。熱意があり, 濃い空間でした。

Fisher Flow Matching, NeurIPS East right now!! Poster number 2606@bose_joey pic.twitter.com/RU0LFV4Pm7

— Oscar Davis (@osclsd) December 13, 2024

Join us at our API-Gen poster!#NeurIPS2024 #NeurIPS

— Juan Carlos Niebles @NeurIPS (@jcniebles) December 12, 2024

📍West Ballroom A-D #5307

📝 https://t.co/XlaXdYEXQq

🌎 https://t.co/RlUvcX4GtE pic.twitter.com/aQd7eCjgR9

Proud advisor moment: My student TaeHo @TaeHo_Y00N had a blast of a poster presentation today at NeurIPS! (1/2) pic.twitter.com/ogASQqtXhp

— Ernest Ryu (@ErnestRyu) December 13, 2023

↑あとこのポスターの発表をしてくださった方, 自分が医療系でECG(not EEG)を扱っていることもあり, 詳しく説明やinspiredされた論文, valuable insightsを与えてくださりありがとうございました。好きな分野にかける熱意は言語の壁を越えることを実感しました。

企業ブースでは名だたるスポンサー企業が勢揃いしていました。こんなに豪華なブースを観たのは初めてかもしれません。

企業ブースでも時間によって企業で取り組んでいることの発表などが行われていました。

かなり日本に在住している人的には驚くべきことに日本ではビックテックと呼ばれる企業もHiring eventをしていました。かなりの割合でminimum qualificationがPhDではあり, 日本でのポストはなかったので当てはまるものは少なかったですが….

📢🔥 My team has several openings for summer research internships & research scientists in the fundamental generative AI space.

— Arash Vahdat ✈️ #NeurIPS2024 (@ArashVahdat) December 11, 2024

To connect with as many people as possible at #NeurIPS2024, I will set a specific time and place for Friday afternoon. Check this tweet later for info.

Teslaのロボットも見れました。この企業ブースに世界中の技術が集まってると思うと感慨深くなりました。

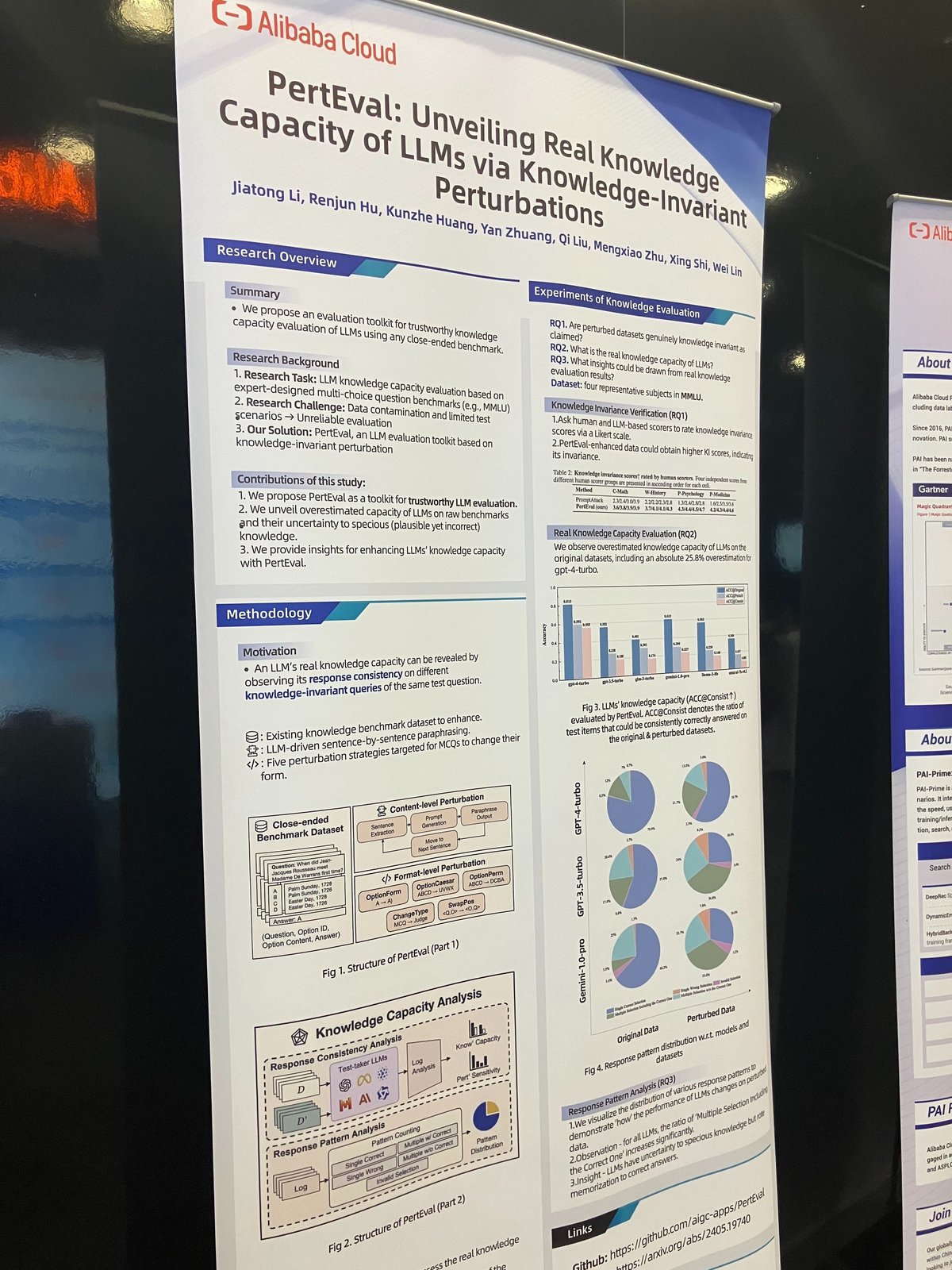

Alibaba cloudはなぜかここでポスター発表をしていました。

あとは色々なSwagももらえました。

本会議に参加して感じたこと

とにかく今まで参加してきた学会の中で学生, 企業の熱意が非常に高かったです。学生側は万単位の聴衆の中何時間も質問攻めを切り抜けていますし, Oralの発表後も「The authors will be on the job market.」と締めくくる発表があり, 研究職に就きたい野心的な態度の学生が多く, 非常に刺激的でした。

論文を読むだけなら別に海外にいかなくても日本国内で良いだろと思っていた時期もありましたが, 実際に現地にいくべきです。論文を検索している際, 知らず知らず検索ワードによるフィルタリングが行われており, 本当に欲しい論文が出てきていない可能性が大いにあります。

NeurIPSという万単位の人が参加する国際カンファレンスでランダムなポスターをランダムウォークすることは全研究者にとっても必要だと考えます。

悲しいことに, 会場内にいたNeurIPSで発表している日本の大学の大学生は非常に少なく, 3桁もいない気がします。国際社会での日本の大学のプレゼンス低下がだとかまで主語目的語をデカくするつもりはないんですが, あまりに日本の大学の学生が参加しておらず危機感を覚えました。日本語が苦手なので上手く表現ができないんですが, 体感的には日本で扱っている手法や常識をよりブラッシュアップさせてくれる経験がNeurIPSにはありました。

それでもNeurIPSに投稿されたネタは2024年5月のネタなので, 今の本当の最先端はさらに進んでいるものなんだと思われます。まだまだ発展していく分野ではあると思うので, 引き続き研鑽していきたいです。

あとはNeurIPSなどの特別な学会を通してHiringもするなどといったルートが海外のPhDには開かれている気がしました。日本でもこういったポストが増えればPhDに心置きなく進める学生も増えるのではないかと思うのですが, これはあまりに浅はかな思考でしょうか

あとは会場で公式の懇親会、ポスター以外で周りの人の雑談に混ざれなかったのが少し心残りですね。 彼らの雑談の中から今本当の最新のAI情報が生まれていた気がします。 そういうのを吸収すべきという点でも対面で参加するメリットを感じました

見てきた発表一部抜粋

見てきた発表でメモしていたものをコメントがあるものはコメント付きで公開します。

TripletCLIP: Improving Compositional Reasoning of CLIP via Synthetic Vision-Language Negatives

Accelerating Pre-training of Multimodal LLMs via Chain-of-Sight

SWE-agent: Agent-Computer Interfaces Enable Automated Software Engineering

Post-training LLMs: From Algorithms to Training Infrastructures: ByteDanceのPost training手法まとめ公演, GitHubに資料は全部公開されています。

On the Comparison between Multi-modal and Single-modal Contrastive Learning

RedPajama: an Open Dataset for Training Large Language Models: 昔からあるデータセットのはずなのになんで今論文になったのかわからなくておもろい

HW-GPT-Bench: Hardware-Aware Architecture Benchmark for Language Models

CLIP in Mirror: Disentangling text from visual images through reflection

FineCLIP: Self-distilled Region-based CLIP for Better Fine-grained Understanding

BAdam: A Memory Efficient Full Parameter Optimization Method for Large Language Models

How Do Large Language Models Acquire Factual Knowledge During Pretraining?

CLIPCEIL: Domain Generalization through CLIP via Channel rEfinement and Image-text aLignment

Interpreting CLIP with Sparse Linear Concept Embeddings (SpLiCE)

Not All Tokens Are What You Need for Pretraining: この論文, top予測tokenを求めるのにreference modelが必要なのですが, そんなモデルがない状況の場合は使えなくないか?と思ったので講演者に凸したところ, そんなモデルがない状況では既に出来合いのモデルを使ってtop予測tokenを求める, 1 step前のモデルを使うなどといった解答をいただきました。

Return of Unconditional Generation: A Self-supervised Representation Generation Method

HydraLoRA: An Asymmetric LoRA Architecture for Efficient Fine-Tuning

Deep Learning in Medical Image Registration: Magic or Mirage?

Thought of Search: Planning with Language Models Through The Lens of EfficiencyxMIL: Insightful Explanations for Multiple Instance Learning in Histopathology

Fast and Memory-Efficient Video Diffusion Using Streamlined Inference

Biomedical Visual Instruction Tuning with Clinician Preference Alignment

Instruction Tuning With Loss Over Instructions: instruction tuningではinstruction部分もloss計算に含めてしまった方が性能が良い場合があるというpaperです。(特定の状況下ではあります)

Medformer: A Multi-Granularity Patching Transformer for Medical Time-Series Classification: github: https://github.com/DL4mHealth/Medformer.

Knowledge-Empowered Dynamic Graph Network for Irregularly Sampled Medical Time Series

MedSafetyBench: Evaluating and Improving the Medical Safety of Large Language Models: 自分が参加した医療系workshop, AIMFMでもOpenAIの医療モデル評価講演がありました

Discovering Preference Optimization Algorithms with and for Large Language Models

Benchmarking Out-of-Distribution Generalization and Adaptation for Electromyography

kGym: A Platform and Dataset to Benchmark Large Language Models on Linux Kernel Crash Resolution

CLIPLoss and Norm-Based Data Selection Methods for Multimodal Contrastive Learning

Sm: enhanced localization in Multiple Instance Learning for medical imaging classification

On the Role of Attention Masks and LayerNorm in Transformers

Curriculum Fine-tuning of Vision Foundation Model for Medical Image Classification Under Label Noise

Decomposing and Interpreting Image Representations via Text in ViTs Beyond CLIP

Copycats: the many lives of a publicly available medical imaging dataset

Implicit Optimization Bias of Next-token Prediction in Linear Models

The Implicit Bias of Adam on Separable DataInterpreting and Analysing CLIP's Zero-Shot Image Classification via Mutual Knowledge

UMFC: Unsupervised Multi-Domain Feature Calibration for Vision-Language Models

Visual Decoding and Reconstruction via EEG Embeddings with Guided Diffusion

QUEST: Quadruple Multimodal Contrastive Learning with Constraints and Self-Penalization

You Only Cache Once: Decoder-Decoder Architectures for Language Models

MetaLA: Unified Optimal Linear Approximation to Softmax Attention Map

MicroAdam: Accurate Adaptive Optimization with Low Space Overhead and Provable Convergence: github: https://github.com/IST-DASLab/MicroAdam

Mini-Sequence Transformer: Optimizing Intermediate Memory for Long Sequences Training

Compressing Large Language Models using Low Rank and Low Precision Decomposition

Differentially Private Set Representations

Noise-Aware Differentially Private Regression via Meta-Learning

The Limits of Differential Privacy in Online Learning

Online Weighted Paging with Unknown Weights

Thought of Search: Planning with Language Models Through The Lens of Efficiency

AutoSurvey: Large Language Models Can Automatically Write Surveys