Akira's ML news #Week 3, 2021

2021年第3週(1/10~)に私が読んだ論文や記事で特に面白かったものを紹介します。なるべく新しいものを紹介していますが、論文投稿日はこの週のものとは限りません。※有料設定してますが、投げ銭用なので全部無料でみれます。

内容 :

1. 論文, 2.技術的な記事, 3.実社会における機械学習適用例, 4.その他話題

今週の注目記事/論文

- token毎に層の切替をすることで、高速に大規模モデルを学習する

- 確信度を高めるパッチを貼ることで、安全性を高める

- 周波数空間における違いを小さくすることで、生成モデルを高性能にする

---------------------------------------------------------------------

1.論文

----------

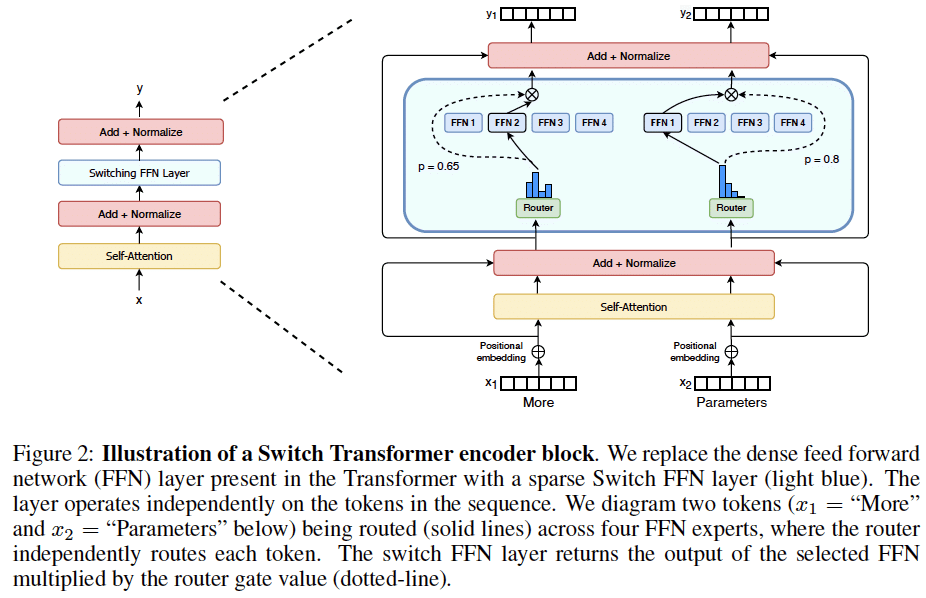

token毎に層の切替をすることで、高速に大規模モデルを学習する

SWITCH TRANSFORMERS: SCALING TO TRILLION PARAMETER MODELS WITH SIMPLE AND EFFICIENTSPARSITY

https://arxiv.org/abs/2101.03961

Self-Attention後にtoken毎の処理を最適な専門層に切り替えて(swtich)行う、大規模なパラメータを使いながら効率的に学習できるSwicth-Transformerを提案。T5と比較するとと65倍のパラメータ数を使いながらも7倍の速さで同じ精度に到達できる。最大モデルのパラメータ数は1.5兆。

実質的に疎なモデルになっている。それぞれのtoken毎に最適なものを選んでいるので大規模モデル大パラメータの利点を活かしつつも、切替により実質的に1token毎に使っているパラメータ数は少ない。デバイス毎にパラメータを展開するなど考えることはまだ多そうだが、モデル大規模化と合わせて1つの潮流になるかもしれない

確信度を高めるパッチを貼ることで、安全性を高める

Unadversarial Examples: Designing Objects for Robust Vision

https://arxiv.org/abs/2012.12235

敵対的サンプルの逆の操作をすることで確信度を高めるようなパッチを作成し、それを貼り付けることで認識精度を高める研究。ドローンの着陸時に認識しないといけない着陸パッドなど、現実世界で認識精度が必要な箇所に貼り付けることで安全性などを高める応用が考えられる。

周波数空間における違いを小さくすることで、生成モデルを高性能にする

Focal Frequency Loss for Generative Models

https://arxiv.org/abs/2012.12821

生成モデルで生成された画像は、その本物っぽさにも関わらず周波数空間でみると実画像との違いがある。離散フーリエ変換を用いて、その差分を最小化する損失関数Focal Frequency Lossを提案。周波数空間での差分を埋めるとともに、ぼやけがちなVAEの生成画像の質が改善する。

仮想的な試着をStyleGAN2で行う

VOGUE: Try-On by StyleGAN Interpolation Optimization

https://arxiv.org/abs/2101.02285

仮想的な試着を行う研究。まずをStyleGAN2をkey point 条件付きで事前学習した後、衣類と体の画像がミックスされるように衣類参照画像と人画像の2つの混合率のようなものを各層で調整させる後学習を行う。

強化学習で最適なDropoutを

AutoDropout: Learning Dropout Patterns to Regularize Deep Networks

https://arxiv.org/abs/2101.01761

Dropoutのパターンを複雑化し、マスク回転なども加え、それらの最適パラメータを強化学習で探索する研究。NASのようにコントローラーで逐次的にパラメータを生成するが、RNNではなくTransformerを用いている。NLP、画像などで効果を確認した。

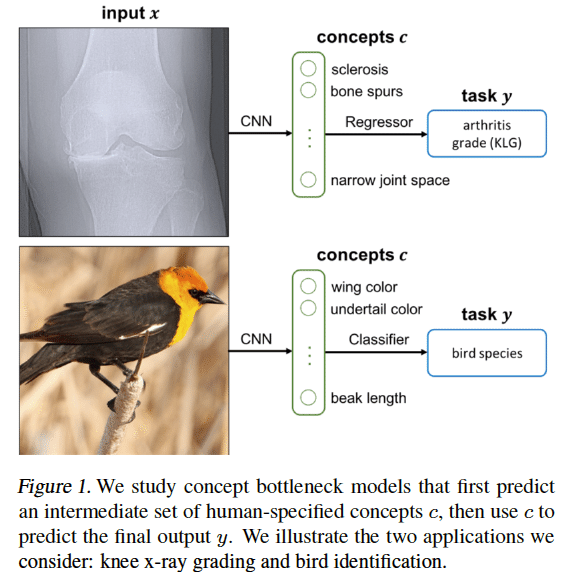

関連情報を介した予測をすることで解釈性を向上させる

Concept Bottleneck Models

https://arxiv.org/abs/2007.04612

正解ラベルの他に関連する情報(concept : 鳥なら羽の色、嘴の長さ)を持っておき、それの予測を介してラベル予測させるモデル。関連情報を出力させるのでモデルの解釈性を向上させられる。モデルの出力するconceptが間違って入ればそれを修正することで推論時の人の介入が可能になる。

剪定がバイアスを助長している

CHARACTERISING BIAS IN COMPRESSED MODELS

https://arxiv.org/abs/2010.03058

モデルサイズを小さくする剪定がバイアスを助長していることを示した研究。剪定により全体の精度は大きく落ちないように見えるが、出現頻度が稀なデータでは大きく精度が落ちているという結果

トラッキングでTransformerを用いる

TrackFormer: Multi-Object Tracking with Transformers

https://arxiv.org/abs/2101.02702

Transformerを用いた物体検出モデルDETRを複数物体追跡(Multi object Tracking)に応用した研究。前フレームの物体を、Decoderのobject queryに追加することで追跡を行う。

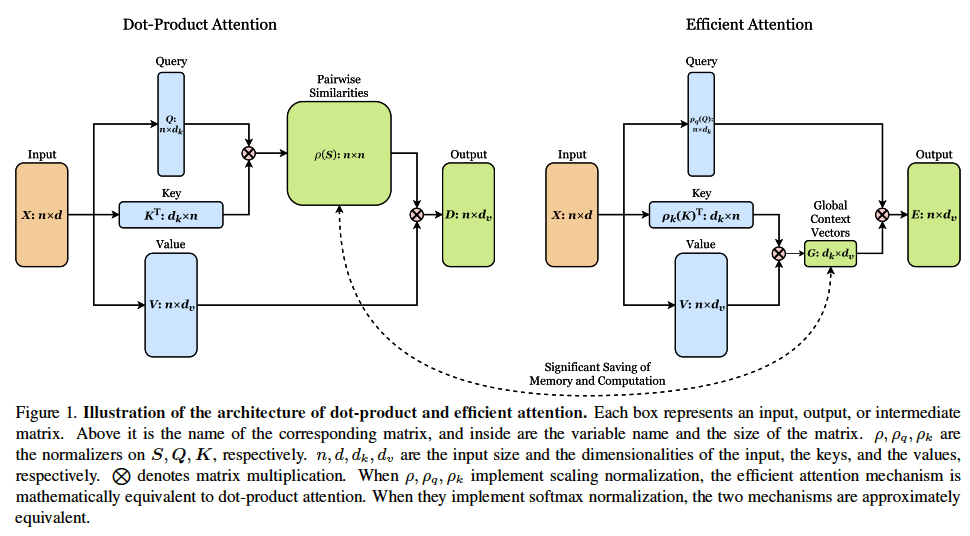

数学的に等価な変換でSelf-Attentionの計算量を削減

Efficient Attention: Attention with Linear Complexities

https://openaccess.thecvf.com/content/WACV2021/papers/Shen_Efficient_Attention_Attention_With_Linear_Complexities_WACV_2021_paper.pdf

Self-Attentionの計算を(QK)VではなくQ(KV)に変更することで、数学的な等価な計算で計算量をn^2→d_k*d_vに削減することが可能。大きな解像度で大幅に計算量が削減できる。物体検知において、non-localの代替として入れることで精度向上を確認した。

---------------------------------------------------------------------

2.技術的な記事

----------

機械学習の監視

ソフトウェアを使ったサービスでは監視が必要なように、機械学習を使ったサービスでも監視が必要。この記事では、機械学習を使ったサービスでは何を監視するか(モデルが古くなってないかを監視するため精度を見る等)、ケーススタディや監視ツールの紹介を解説している。

Paper with Codeから見た2020のトレンド

Paper with Codeで人気があった論文、ライブラリ、ベンチマークデータセットをまとめている。

---------------------------------------------------------------------

3.実社会における機械学習適用例

----------

DeepFakeの活用方向性

DeepFakeはフェイクポルノをはじめ社会問題となっているが、それらの使われ方を良いものと悪いものとを解説した記事。良い使い方としては内部告白者の顔を変えてその人を守ったり、多言語国家の政治家がそれぞれの母語で話すプロモーションを出したり、エンタメとしての歴史のIFビデオなど。

医療x機械学習の問題点

医療x機械学習の問題点を指摘した記事。医療x機械学習がメディアを騒がしているが、機械学習はデータに依存しており、医療データは簡単に欠落したり偏ったり、理解不足からデータが不適切に収集されている場合もある。さらにアルゴリズムの実装ミスにより、援助が滞ったケースも紹介している

---------------------------------------------------------------------

4.その他話題

----------

アメリカがAI技術者を求めている

オバマ政権下で最高経済顧問を努めたファーマン氏へのインタビュー。トランプ政権下では技術者や学生が米国に来ることを阻む政策をとっていたが、バイデン政権ではそれをどうにかすることが必要だと述べている

CPUで深層学習モデルを学習する

GPUではなくCPUを深層学習用のヘードウェアにするスタートアップの話。GPUはそれ単独で機能できず、CPUとの接続を必要とする。Neural Magicは単独で機能でき、かつ既存のPCで広く深層学習モデルを利用できるように、CPUを利用した学習ができるソフトウェアを開発している。

---------------------------------------------------------------------

過去の記事

2021 Week 2の記事⇦2021 Week 3の記事(コレ)⇨2021 Week 4の記事

2020年10月のまとめ

2020年11月のまとめ

2020年12月のまとめ

2020年の総まとめ

---------------------------------------------------------------------

記事は以上です。ここから下は有料設定になっていますが、特に何もありません。この記事が気に入って投げ銭しても良いという方がいましたら、投げ銭をして頂けると嬉しいです。

TwitterでMLの論文や記事の紹介しております。

https://t.co/l8jrhR6RnH

— akira (@AkiraTOSEI) January 13, 2021

Self-Attention後にtoken毎の処理を最適な専門層に切り替えて(switch)行う、大規模なパラメータを使いながら効率的に学習できるSwith-Transformerを提案。T5と比較するとと65倍のパラメータ数を使いながらも7倍の速さで同じ精度に到達できる。最大モデルのパラメータ数は1.5兆 pic.twitter.com/fYJVY0jRpT

ここから先は

Akira's ML news & 論文解説

※有料設定してますが投げ銭用です。無料で全て読めます。 機械学習系の情報を週刊で投稿するAkira's ML newsの他に、その中で特に…

記事を書くために、多くの調査や論文の読み込みを行っております。情報発信を継続していくためにも、サポートをいただけると非常に嬉しいです。