【論文瞬読】複数のAI頭脳を組み合わせて超絶パワーアップ!? 新技術「Mixture-of-Agents」が示す驚きの可能性

こんにちは!株式会社AI Nestです。今回は、最近話題の論文「Mixture-of-Agents Enhances Large Language Model Capabilities」について、詳しく解説していきます。この論文が提案する新技術は、AIの世界に革命を起こす可能性を秘めているんです。さあ、一緒に最新のAI研究の世界を覗いてみましょう!

タイトル:Mixture-of-Agents Enhances Large Language Model Capabilities

URL:https://arxiv.org/abs/2406.04692

所属:Together AI, Duke University, University of Chicago, Stanford University

著者:Junlin Wang, Jue Wang, Ben Athiwaratkun, Ce Zhang, James Zou

1. Mixture-of-Agents(MoA)って何?

まず、「Mixture-of-Agents」(以下、MoA)とは何なのか、簡単に説明しましょう。

MoAは、複数の大規模言語モデル(LLM)を組み合わせて、より高性能なAIシステムを作り出す新しい方法です。簡単に言えば、「AIの頭脳を複数組み合わせて、超賢いAIを作る」というアイデアなんです。

従来のアプローチでは、単一の巨大なAIモデルを作ることに注力していました。でも、MoAは違います。既存のAIモデルたちの「得意分野」を活かして、それらを巧みに組み合わせるんです。まるで、専門家たちがチームを組んで難問を解決するように!

2. MoAの仕組み:AIたちの頭脳合体!

では、MoAはどのように動作するのでしょうか?その仕組みを、できるだけわかりやすく説明していきます。

階層構造:MoAは複数の「層」で構成されています。各層には複数のAIモデル(エージェント)が配置されています。

プロポーザーとアグリゲーター:AIモデルには2つの役割があります。

プロポーザー:問題に対する回答を提案する役割

アグリゲーター:他のAIの回答を集約して、より良い回答を生成する役割

段階的な回答生成:

第1層:複数のAIが独立して回答を生成します。

第2層以降:前の層の回答を参考にしながら、新たな回答を生成します。

最終層:最後のアグリゲーターが、全ての情報を統合して最終的な回答を作り出します。

このプロセスを通じて、MoAは各AIの強みを活かしつつ、弱点を補完し合うことができるんです。

3. MoAの驚異的な性能:GPT-4を超える!?

さて、ここからが本当に驚きの部分です。研究チームが行った実験の結果、MoAは既存の最高峰AIモデルであるGPT-4 Omniの性能を上回ったのです!

具体的には、以下のようなベンチマークテストで優れた結果を示しました:

AlpacaEval 2.0:人間の好みに沿った回答ができるかを評価するテスト

MoA:65.1%

GPT-4 Omni:57.5%

MT-Bench:多様なタスクに対する回答の質を評価するテスト

MoA:9.25点

GPT-4 Omni:9.19点

特筆すべきは、MoAがオープンソースのAIモデルのみを使用してこの結果を達成したことです。つまり、誰でも利用可能な技術だけで、最先端の商用AIを上回る性能を実現したのです。これはAI研究界隈に衝撃を与えました。

4. MoAのメリット:コスト効率と柔軟性

MoAの魅力は性能だけではありません。コスト効率の面でも大きな利点があるんです。

研究チームの分析によると、MoAはGPT-4 Turboと同等の性能を、なんと半分のコストで実現できるそうです。上の図を見ると、MoAが他のモデルと比較して、コストパフォーマンスに優れていることが一目瞭然ですね。AI技術の実用化において、コストは常に大きな課題でした。MoAはこの課題に対する有力な解決策となる可能性を秘めています。

また、MoAは非常に柔軟性が高いのも特徴です。新しいAIモデルが登場したら、それをMoAのシステムに組み込むだけで全体の性能を向上させることができます。つまり、AIの進化に合わせて、システム全体も進化し続けられるんです。

5. MoAが示す「AIの協調性」という新発見

MoAの研究過程で、研究チームは興味深い現象を発見しました。それが「AIの協調性」です。

彼らが発見したのは、AIモデルが他のAIモデルの出力を参照することで、自身の回答の質が向上するという現象です。上の図を見てください。他のモデルの回答を参照した場合(オレンジ色のバー)、そうでない場合(青色のバー)と比べて、明らかに性能が向上していますね。しかも、参照するAIの回答が自分よりも質が低い場合でも、この現象は起こるんです。

これは人間社会でいえば、「他人の意見を聞くことで、自分の考えがより深まる」というのに似ていますね。AIにもこのような「協調性」があることが分かったのは、大きな発見だと言えるでしょう。

6. MoAの多面的な能力

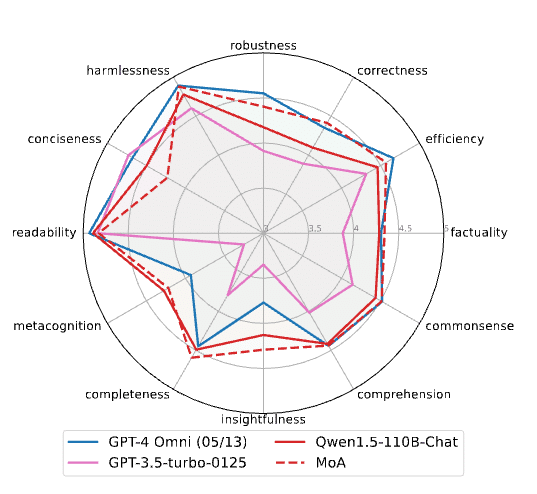

MoAの優れた点は、単に全体的な性能が高いだけではありません。様々な能力において、バランスの取れた高いスキルを示しています。

この図は、MoAの様々なスキルセットにおける性能を示しています。例えば、正確性(correctness)、事実性(factuality)、洞察力(insightfulness)、完全性(completeness)などの重要な指標で、MoAはGPT-4 Omniを上回っています。

特に注目すべきは、MoAがロバスト性(robustness)や効率性(efficiency)でも高いスコアを示していることです。これは、MoAが単に「賢い」だけでなく、様々な状況や課題に対して安定して高いパフォーマンスを発揮できることを意味しています。

7. MoAの課題と今後の展望

もちろん、MoAにも課題はあります。最も大きな課題は、回答生成に時間がかかることです。複数のAIモデルを経由するため、最初の回答が出るまでの時間(TTFT: Time to First Token)が長くなってしまうんです。

研究チームは、この問題を解決するためにいくつかのアイデアを提案しています。例えば、MoAの層の数を減らしたり、回答を一度にまとめて生成するのではなく、チャンク(塊)ごとに生成する方法などです。

今後の研究では、この課題の解決とともに、以下のような点にも注目が集まりそうです:

より多様なタスクやドメインでのMoAの性能評価

MoAの長期的な学習能力や適応能力の研究

MoAを使用する際の倫理的な側面の検討

8. まとめ:AIの未来を変える可能性を秘めたMoA

MoAは、AIの性能向上に全く新しいアプローチを提示しました。単一の巨大AIモデルを作るのではなく、既存のAIモデルたちの「得意分野」を活かして組み合わせる。この発想の転換が、AIの世界に革命を起こす可能性を秘めているんです。

MoAの研究はまだ始まったばかりです。しかし、その可能性は計り知れません。より高性能で、コスト効率の良いAIシステムの実現。それは、AI技術の民主化と、より多くの人々がAIの恩恵を受けられる世界につながるかもしれません。

AIの進化は、まだまだ続きます。MoAが切り開く新たな地平線に、これからも注目していきましょう!