【論文瞬読】LLMは長文読解も短文でOK!? コンテキスト長はもう不要?「LC-Boost」で変わるAIの未来

こんにちは!株式会社AI Nestです。テックブログのお時間です。今回は、大規模言語モデル(LLM)界隈で話題になっている論文「Are Long-LLMs A Necessity For Long-Context Tasks?」をわかりやすく解説しちゃいます!

タイトル:Are Long-LLMs A Necessity For Long-Context Tasks?

URL:https://arxiv.org/abs/2405.15318

所属: Gaoling School of Artificial Intelligence, Renmin University of China, Beijing Academy of Artificial Intelligence

著者:Hongjin Qian, Zheng Liu, Peitian Zhang, Kelong Mao, Yujia Zhou, Xu Chen, Zhicheng Dou

長文読むの、意外と大変じゃない?

最近、ChatGPTをはじめとするLLMがいろんなところで使われてますよね。長ーい文章の質問に答えたり、要約したり...。すごいんだけど、ちょっと気になる点も。

実は、LLMって長文を扱うのが結構苦手なんです。例えば、数万単語の文章を処理しようとすると、計算量が爆発的に増えて、時間もお金もかかっちゃう。

💡解決策:長文を細かく分けて考えよう!

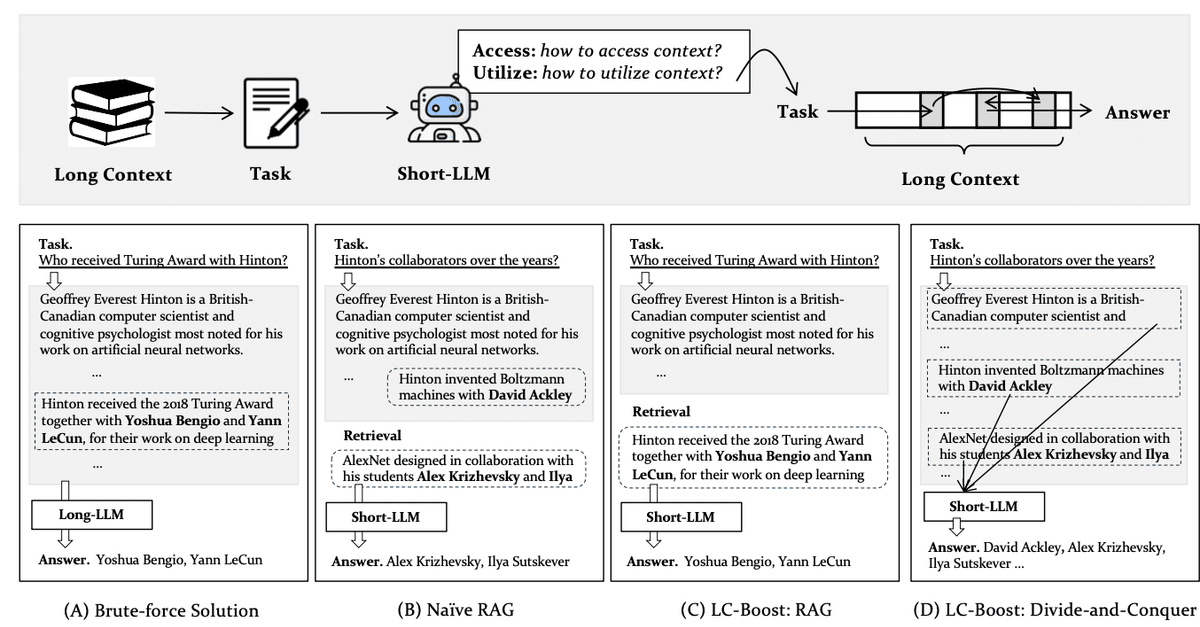

そこで、今回の論文が提案しているのが「LC-Boost」という新しいフレームワーク。

LC-Boostの考え方はシンプル。長文を短いチャンクに分割して、LLMに順番に処理させるんです。

「え、それだけ?」と思うかもしれませんが、LC-Boostのすごいところは、各チャンクをどのように扱うかをLLMが自分で判断するところです。

例えば、質問に答えるために必要な情報がどこにあるか、LLMが自分で考えて検索してくれたり、情報をうまくまとめるためにどのチャンクを組み合わせればいいかなどを判断してくれます。 (論文中の図1参照)

実験結果:短文LLMが長文LLMに匹敵!?

論文では、このLC-Boostを使って、質問応答や要約などのタスクで実験しています。その結果、なんと、短いコンテキストしか扱えないはずのLLMが、長文コンテキストを扱えるLLMに匹敵する性能を叩き出したんです!しかも、消費エネルギーは大幅に削減! (論文中の図4参照)

これはすごい!

まとめ:LLMの未来は明るい!

LC-Boostは、LLMが抱える長文処理の問題を解決する画期的なアプローチです。これによって、LLMがもっと身近に、もっと効率的に使えるようになる未来が見えてきました。

もちろん、LC-Boostにも課題はあります。例えば、すべてのタスクで同じように効果を発揮するわけではないことや、より複雑な推論が必要なタスクへの対応など、まだまだ改善の余地はたくさんあります。

しかし、今回の論文は、LLMの未来を大きく変える可能性を秘めていると言えるでしょう。今後の研究に期待ですね!

最後に

今回の論文解説、いかがだったでしょうか?LLMの世界は日進月歩で進化しています。これからも、最新の研究成果をわかりやすく解説していきますので、お楽しみに!