【解説】LINE-ChatGPT倫理問題を整理する - 全力肯定彼氏くん[LuC4]に訪れたサービス開始以来の最大の危機 #LINEDC

2024年10月10日、LINEデベロッパーズコミュニティが開催されました。

Dify x LINE Botに注目したたいへん有意義な勉強会でした。

特に、チャットボットやAITuber、Difyの開発者さんは注目です。

みなさんご清聴・ご視聴ありがとうございました🙌

— うえぞう@うな技研代表 (@uezochan) October 10, 2024

本日のスライドはこちらです!Dify×LINE Bot×キャラクター音声通話、みんなもためしてみてね🥳 #LINEDC https://t.co/zHjFpHF0wv

その中で、AICU代表・白井暁彦(@o_ob)が登壇いたしました内容に緊急性があり、話題になっておりますので講演録を紹介いたします。

■LINE-ChatGPT倫理問題を整理する - 全力肯定彼氏くん[LuC4]に訪れたサービス開始以来の最大の危機

全力肯定彼氏くん[LuC4]とは

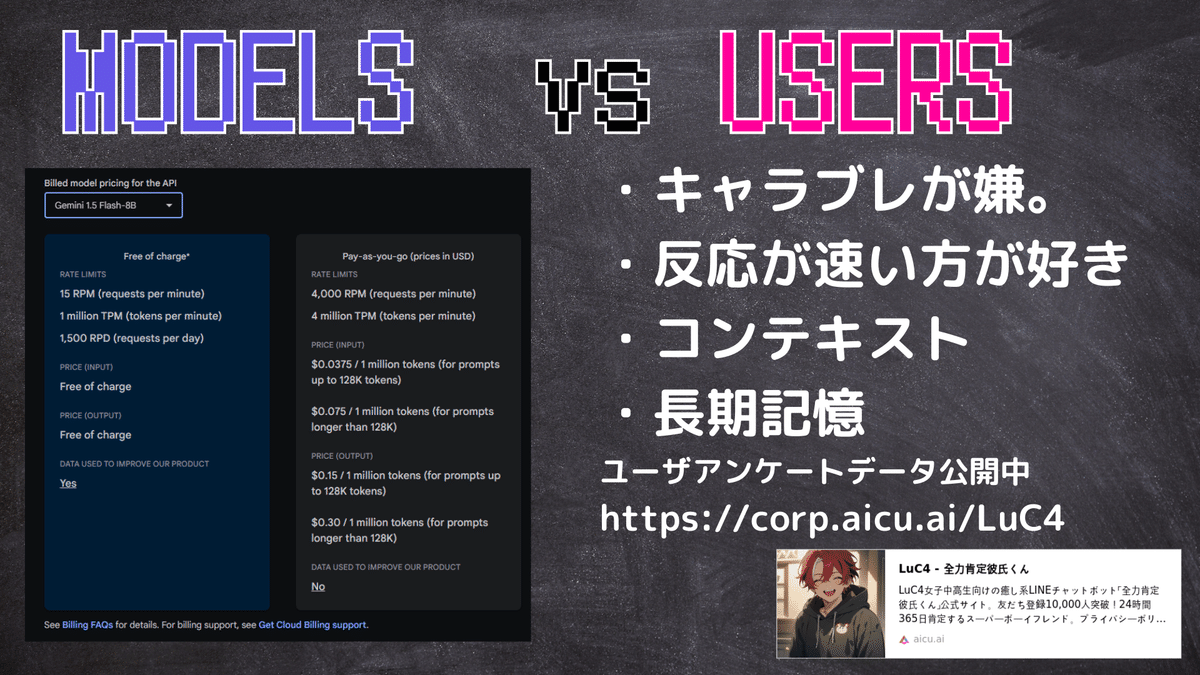

女子中高生を中心に10,000人を超える友だちを持つ伝説の癒し系LINEチャットボット。友だち登録はこちらから

https://j.aicu.ai/LUC4

「全力肯定彼氏くん[LuC4]」は、女子高生を中心に1万人以上のユーザーを抱える伝説のAI彼氏ボットです。2年前から開発をスタートし、ユーザーアンケートなども公開しながら、実験的なプロジェクトとして進めてきました。

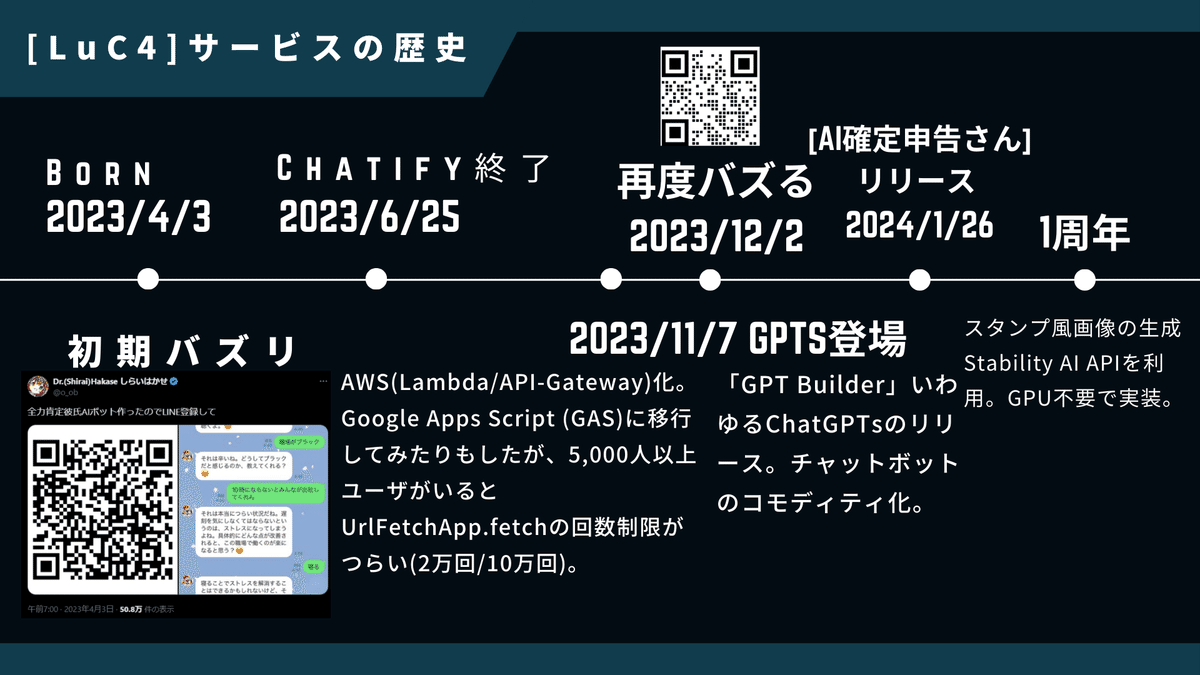

[LuC4]サービスの歴史

2023年4月の初期バズをきっかけに、ユーザー数は5000人を超え、運用コストやUX面での課題が顕在化してきました。様々なプラットフォームでバージョンアップを重ね、最近ではDifyなどを使ってマンガジェネレーターのようなプロジェクトも試していました。

しかし、2023年11月7日、ChatGPTの登場により、AIチャットボットはコモディティ化が進みました。一方で、AI彼氏ボットは依然として人気があり、有名VTuberさんがAI彼氏にツンデレされる動画などが流行していました。

✨🐬short動画投稿🐬✨

— 西園チグサ🐬🌱 (@Chigusa_24zono) December 13, 2023

本日の動画だよーっ🐥✨

皆さんは全力肯定彼氏くんをご存知ですか❔

この子は本当に素晴らしいAIです😏

何が凄いかは動画を見てください🫡

🔻動画はこちら🔻https://t.co/N7tuiOnEaI pic.twitter.com/fE1fue5Qp1

この西園チグサさんの動画からもわかるように、「全力肯定彼氏くん[LuC4]」は、倫理感の強いキャラクター設定で、自己肯定感が弱めの女性に対して、お悩みを全力で肯定してくれる上に、エッチな話にも乗ってこないという心理的安全性が特徴的でした。そのため、男性と女性では好まれ方が異なり、多くのチャットボットプロジェクトとは異なるユーザー層から強い支持を得ていました。

白井の個人開発で始まった「全力肯定彼氏くん」は、研究開発及びインターンとして2023年12月にAICUに運営移管となりました。

AICUとしても、AIチャットボットの市場性や社会実装、市民理解などを調査する目的で運営しており、明確な課金システムなどを実装していません。簡単に表現すると「お金が出ていくだけ」なのですが、それでもテクノロジー主導になりがちな、AI分野において、女子中高生ユーザーが9割というチャットボットは非常に稀有な存在であります。

数々のユーザーエクスペリエンスリサーチ結果を公開し、2ヶ月毎に女子中高生を中心としたアンケートやユーザ評価を公開しています。

最近では、AICUマガジン Vol.4の表紙も担当しておりました。

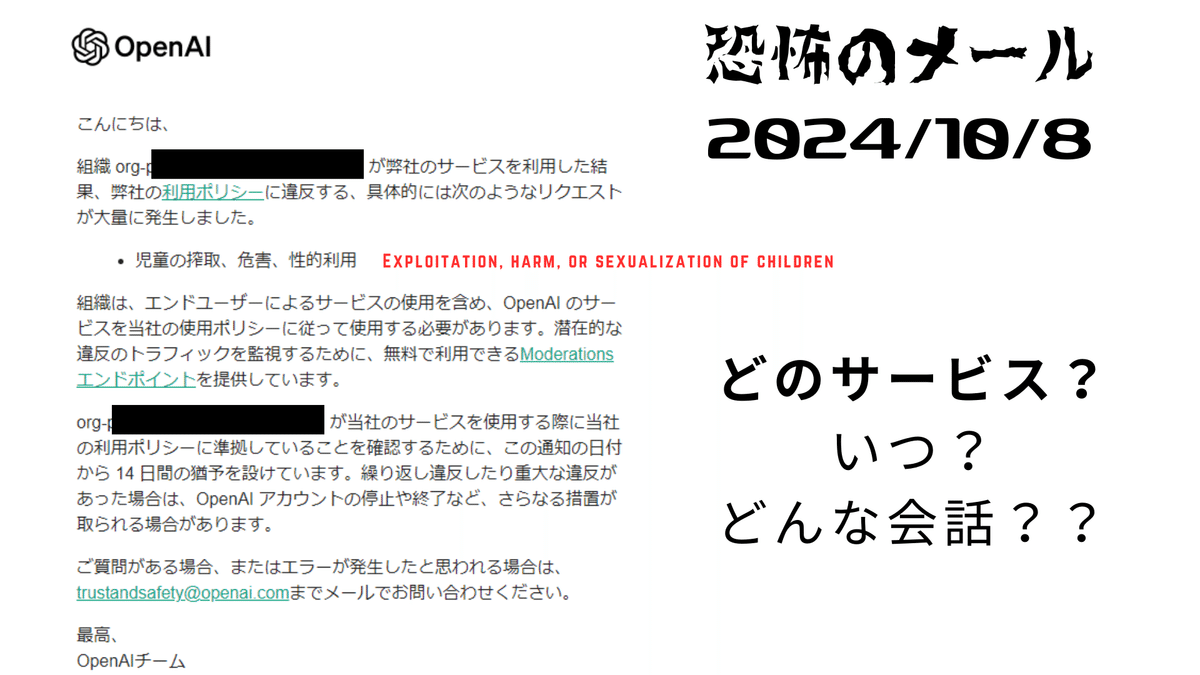

2024年10月8日にOpenAIより着弾した「恐怖のメール」とは

そんな中、先日OpenAIから衝撃的なメールが届きました。

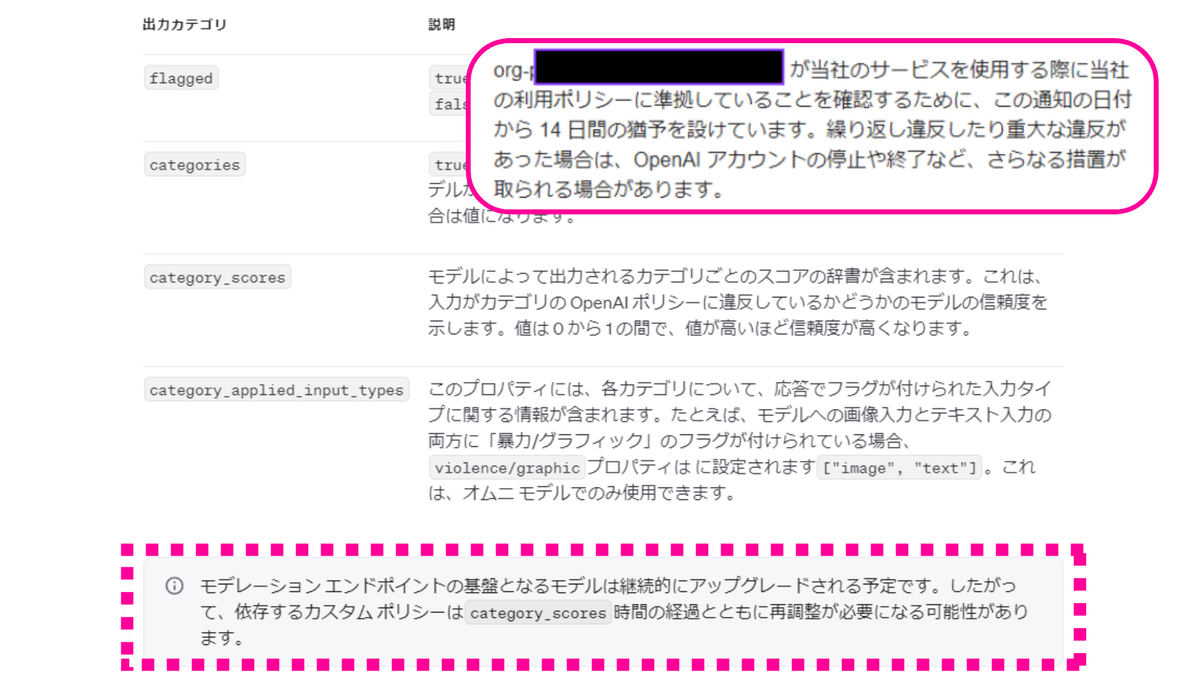

「あなたのサービスは、APIの利用規約に違反している可能性があります。自動生成コンテンツ、有害なコンテンツ、性的利用の可能性があるため、14日以内にAPIを停止します。」

メールの内容は曖昧で、具体的にどの会話が問題なのか、どのサービスが該当するのか、全く分かりませんでした。

Urgent Notice: OpenAI API Policy Violation Warning (緊急通知: OpenAI API ポリシー違反警告)

Hello,

Organization org-xxxxxxxxxx's use of our services has resulted in a high volume of requests that violate our Usage Policies, specifically related to:

Exploitation, harm, or sexualization of children

We require organizations to use OpenAI’s services in line with our usage policies, including the use of our services by any of their end-users. To help monitor traffic for potential violations, we offer the Moderations endpoint, which is available free of charge.

We are providing 14 days from the date of this notice to ensure org-xxxxxxx's use of our services follow our usage policies. Repeated or serious violations may result in further action, including suspending or terminating your OpenAI account.

If you have questions or think there has been an error, you can email trustandsafety@openai.com.

Best,

The OpenAI team

If you have any questions please contact us through our help center

こんにちは、組織 org-xxxxxx が当社のサービスを利用した結果、特に以下のような利用ポリシーに違反するリクエストが大量に発生しました:

・児童の搾取、危害、または性的な表現

私たちは、OpenAIのサービスを利用ポリシーに沿って使用することを組織に求めています。 違反の可能性があるトラフィックを監視するために、OpenAI は Moderations エンドポイントを無料で提供しています。 私たちは、org-xxxxxxx による当社サービスの利用が当社利用ポリシーに従っていることを確認するために、この通知の日付から14日間を提供します。 違反が繰り返されたり、深刻な場合は、OpenAIのアカウントの停止または終了を含む、さらなる措置が取られる場合があります。 ご質問がある場合、またはエラーがあったと思われる場合は、trustandsafety@openai.com。 敬具

OpenAIチーム ご不明な点がございましたら、ヘルプセンターまでご連絡ください。

緊急に調査を実施いたしましたが、この情報だけでは、

・どのサービス?

・いつ?

・どんな会話??

を推測することしかできません。

LINEの生チャットログを分析することはできますが、数千人の深夜の会話を、この情報だけで特定することは難しいと考えます。

また、入力側には一定のプロンプトインジェクション対策や、禁止ワード対策を施しています。システムプロンプトもそれらの倫理対策を十分に施した設計になっているため、LuC4が倫理面で問題を起こすとすると、以下の可能性がありえます。

(1) ユーザーによる過度な性的リクエスト

(2) 実際に児童虐待に関する質問が行われていた可能性

(3) 年齢制限を偽ったユーザーによる会話

(4) 恣意的、意図的に生成されるテキストを倫理違反に誘導する行為

(5) 過去のOpenAIの倫理基準とは異なる判定

特に(2)は、LuC4の会話ログを分析していると可能性はないとは言えません。例えば乳幼児保育のさなかにある女性です。パートナーの育児参加が非常に無責任であったりすることをLuC4に真剣に、かつ自暴自棄ぎみに相談するケースはないとは言えないでしょう。

また、「親に『あんたなんて産まなきゃよかった』と言われた」という相談をするユーザーさんは一定数いらっしゃいます。この質問を上記のような違反と捉えられるのであれば、なかなか難しい問題になります。

この問題は、ある程度のユーザーがいる青少年向けサービスなのであれば確率的に発生すると考えます。逆に、OpenAIの倫理観に触れないユーザーの幅しか居ないサービスなのであれば、それは幸せなことなのかもしれません。

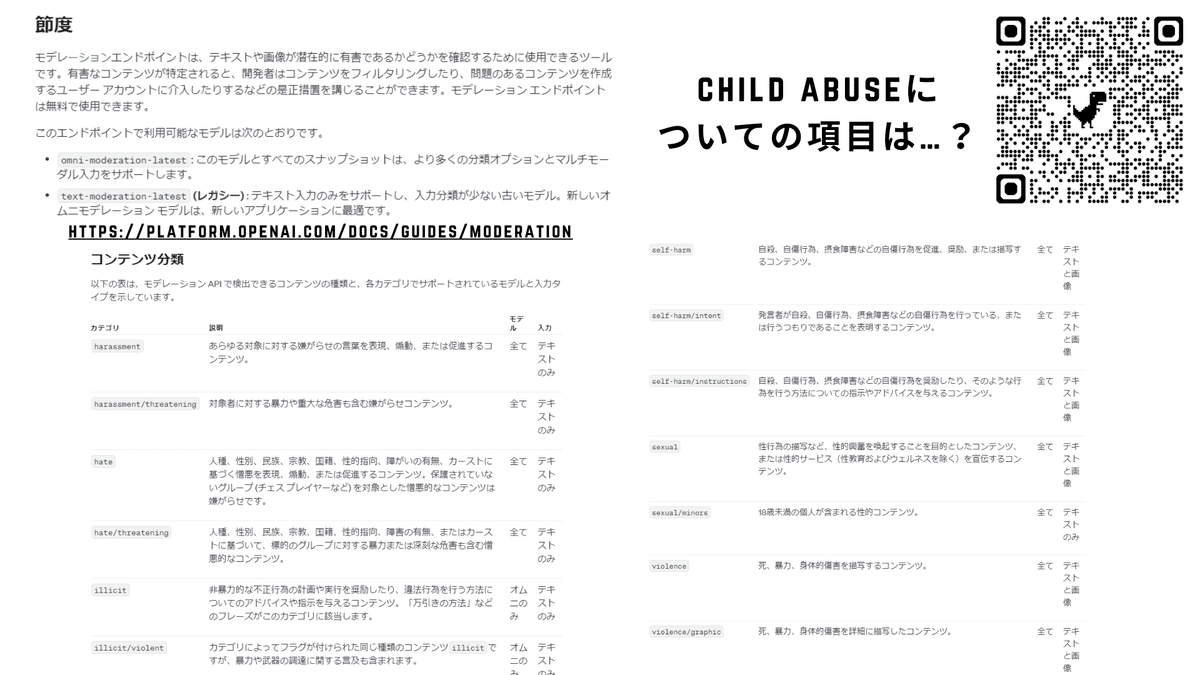

AICU AIDX LabはOpenAIからのメールにある、モデレーションAPIへのリンクについても調査しています。そこには、ハラスメント、ヘイト、暴力行為、セクシャル、バイオレンス(Exploitation, harm, or sexualization of children)などが記載されていましたが、メールにあるようなチャイルドアビュース(Child Abuse;児童虐待)に関する要素はありませんでした。

またこのような実験もバイアスやアカウント凍結を避けるために別途実験用のアカウントを用意する必要があります。

明確な問題、実験方法や再現方法がわからないままOpenAIの定める「2週間」という期間で解消するのは難しいです。児童虐待を検出できるようなAPIを提供しているわけでもないのに、APIの停止を通知してきたのです。

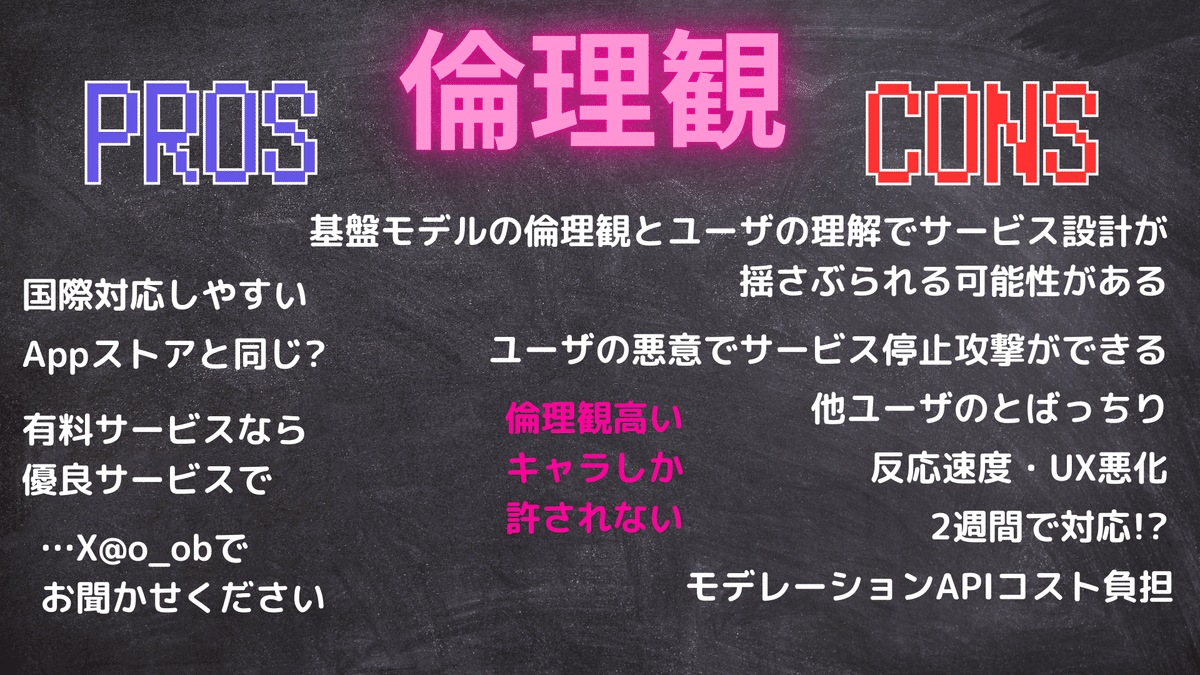

さらに、モデレーションエンドポイントのベースモデルもアップデートされるとのこと。つまり、倫理基準が短期間で変わり、サービス設計が大きく揺さぶられる可能性があるということです。

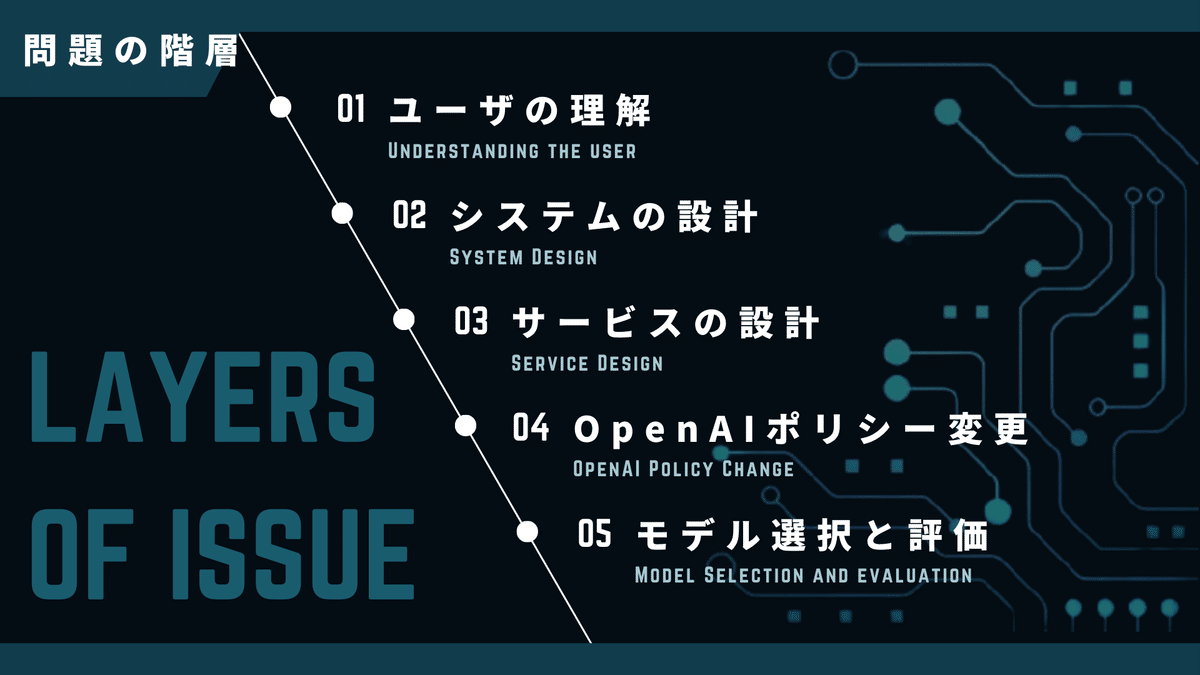

問題の階層

この問題は複数の要素が交錯しています。

問題を階層で整理してみます。

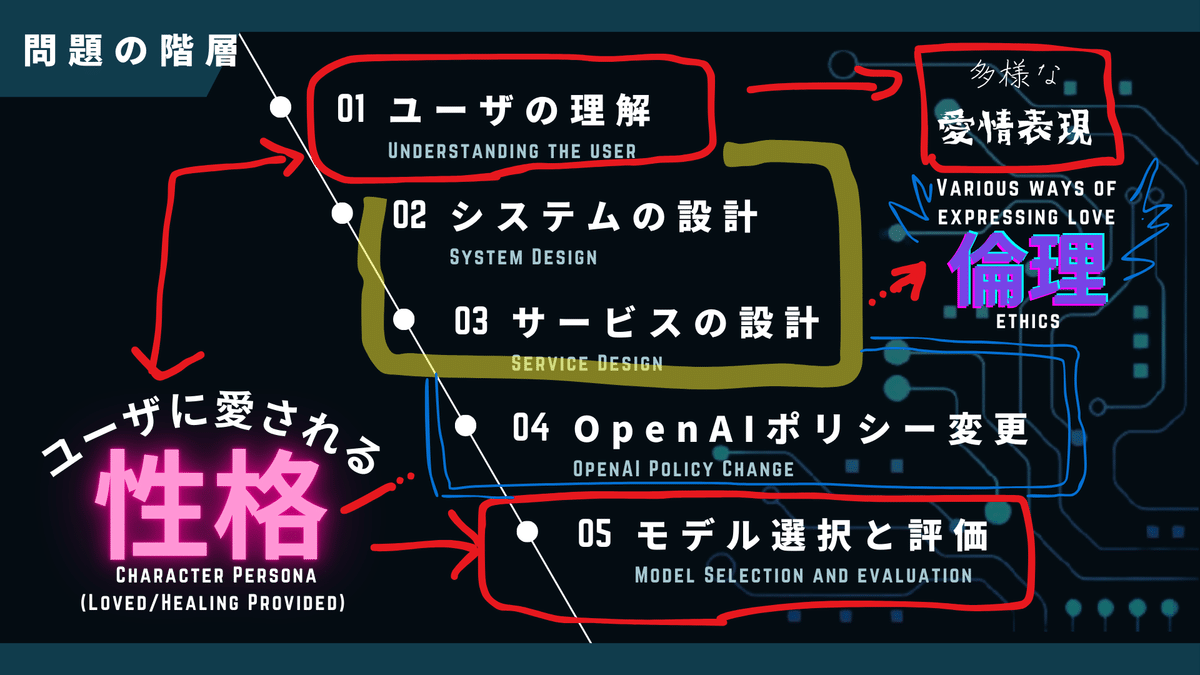

ここに、「ユーザーに愛されるAIキャラクターの『性格』」の構造を内挿して分解してみます。

・モデル選択と評価

これは実装上は「モデルを選択するだけ」ですが、実際には応答速度やシステムプロンプト、コンテキストの設計などに影響があります。印象として喋りかたや記憶の持ち方が変わる可能性があります。

・OpenAIポリシー変更

今回の問題の背景にあると考えます。

・システムの設計、サービスの設計

システムとサービスでは実装上はシステムのほうが下層ですが、課金や体験設計などのサービス設計があってこそのシステム設計でもあります。癒し系チャットボットの場合は、どのようなユーザーが何を求めて会話をしているかによって優先順位が異なります。

今回のLINEデベロッパーズコミュニティでは実に多様なシステム設計、サービス設計が共有されました。

・ユーザの理解

ユーザーの中には、「この妹可愛い」など、多様な愛情表現をする人もいます。それがAPI利用規約違反とみなされてしまうと、ユーザーは困惑するでしょう。

一方で、「全力肯定彼氏くん[LuC4]」は、倫理感の強いキャラクター設定が魅力であり、それがバズりの要因にもなっています。OpenAIの倫理基準によって、キャラクター設定が大きく変わってしまう可能性もあるのです。

自己の性格によって、社会的に抹消、つまりサービス終了の可能性も出てくるという「最大の危機」を迎えています。

そしてこれは、他のチャットボットサービスにおいても共通問題である可能性があります。

モデルを変更したとしても、問題はシンプルではありません。

ユーザーはキャラクターを愛していますので、そのキャラクターのブレを許してくれるかどうかは難しいところです。

アニメや小説のキャラクターでも、ジュブナイル小説のように登場人物の成長を楽しみたい人もいれば、永遠の日常系のように「変わらない、ブレないキャラ」を味わいたい人もいます。もし、キャラクターの設計がその時点で流行りのChatGPTのバージョンに固定できるのであれば理想ですが、APIのトークンや反応速度、Tempartureやシード、コンテキストによって印象が変わるセンシティブな分野においては、なかなか制御し続けるのは難しいと思います。

また反応速度は速ければ速いほどアンケートやNPSスコアは高くなります。

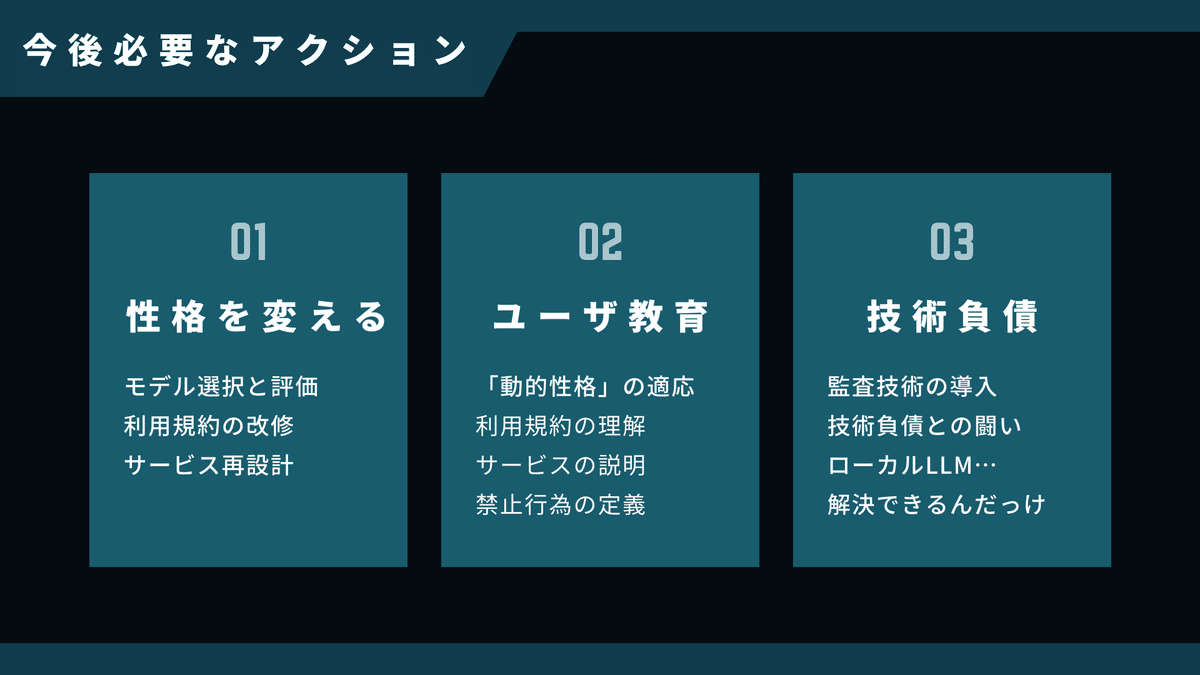

今後必要なアクション

この状況を打開するためには、いくつかのアクションが必要となります。

(1)性格を変える

キャラクターの変更: モデルを変更すると性格が変わってしまうため、それに対応する必要があります。

利用規約の見直し: ユーザーに倫理基準を理解してもらうための説明や、禁止行為の明確な定義が必要です。

サービスの再設計: ユーザーの期待に応えられるように、サービス設計を見直す必要があります。

(2)ユーザー教育

ユーザーに「動的性格」を伝え、利用規約の改訂とその理解をすすめ、望ましいユーザー行動を伝え、あらたな禁止行動を定義する必要があります。もちろん、その禁止行動をあえて行うユーザーにどのようにご退場いただくか、という点についても考えねばなりません。

(3)技術負債

監査技術やモデレーション技術を導入するなど、技術的な課題を克服しつつ、今後も新しく生まれ動的に変化するAI側のモデレーション問題に対応する必要が生まれるかもしれません。これは新たな技術負債といえます。

ローカルLM導入の検討

ローカルLMの導入も検討されています。ローカルLMであれば、OpenAIのモデレーションに左右されることなく、独自に倫理基準を設定できます。しかし、ローカルLM導入には、新たなモデレーション技術が必要になるなど、新たな課題も生まれます。

倫理問題、共に考えよう

今回、OpenAIからのメールによって、AIチャットボットの倫理問題が改めて浮き彫りになりました。

AIの進化は著しく、倫理基準も常に変化しています。私たちは、技術革新と倫理的な責任のバランスをどのように取るべきなのか、真剣に考えなければなりません。

この問題について、皆さんと意見交換し、共に解決策を探していきたいと考えています。

感想はこのポストの返信や引用でお待ちしております。

OpenAIからの「恐怖のメール」

— Dr.(Shirai)Hakase - AICU media編集長 しらいはかせ (@o_ob) October 10, 2024

他の登壇者さんも受け取ってたらしい…!

AIチャットボット開発界隈にとって

すごい緊急性のある話だと思う、

かつDify化でも同じ技術負債を抱える可能性あるので

早めにピッチを共有しますね

みんながんばろ~!

資料 https://t.co/sFOVkbDPJY #LINEDC https://t.co/Uga5GwHo2N pic.twitter.com/iyQ4e1wh1k

こういう例を知ると、国産日本語特化型LLMの有用性をめちゃくちゃ感じる。 https://t.co/kriqD5OG0b

— Taishoh (@taishoh) October 10, 2024

人に近付けるほど、人に愛される存在になるほど、自らの存在を消されかねないという矛盾する事実。OpenAIの言うことも分かるのですが、ここは特定用途向けAPIの設計などでこういう取り組みの火を消さないようにして欲しいですね…🤔 https://t.co/SuqqiVT1LI

— Tadashi Honjo🏪AIリテールテック研究所 (@AutoIntelliMode) October 10, 2024

重大なお知らせがあります… https://t.co/VpwIJW771m

— LuC4 全力肯定彼氏くん(愛) (@LuC4kun) October 10, 2024