ComfyUIが最新動画生成モデル「Wan2.1」にネイティブ対応!デスクトップアプリも大幅更新

AICU media編集部です。この度、ComfyUIが最新の動画生成モデル「Wan2.1」にネイティブ対応したことを発表しました!

Today we are excited to share ComfyUI’s native support for Wan2.1 @Alibaba_Wan ! Get ready for a big new wave of open video model releases!

— ComfyUI (@ComfyUI) February 26, 2025

- 14B/1.3B options available!

- High-quality 720p 14B generation with 40GB VRAM & down to 15GB VRAM for 1.3B model

- Good success rate!… pic.twitter.com/eGHRhJ3mSn

Wan2.1は、中国Alibaba製のオープンモデルです。

🚀 Announcing Wan2.1 - The Next Evolution in AI Video Generation!

— Wan (@Alibaba_Wan) February 25, 2025

We're thrilled to open-source our cutting-edge video generation suite!#AIart #OpenSource

Wan2.1ファミリーの注目ポイント

一般ユーザー向けGPUをサポート: T2V-1.3Bモデルは、わずか8.19GBのVRAMしか必要としないため、ほとんどの一般ユーザー向けGPUで動作可能です。RTX 4090では、約4分で5秒間の480P動画を生成できます(量子化なし)。

複数タスクに対応: Wan2.1は、テキストから動画、画像から動画、動画編集、テキストから画像、動画から音声など、多様なタスクに対応し、動画生成分野を前進させます。

ビジュアルテキスト生成: Wan2.1は、中国語と英語の両方のテキストを生成できる、初めての動画モデルです。

強力な動画VAE: Wan-VAEは、時間情報を保持しながら、あらゆる長さの1080P動画をエンコードおよびデコードできる、卓越した効率とパフォーマンスを提供します。動画および画像生成のための理想的な基盤となります。

ComfyUIデスクトップアプリで体験

ComfyUIのデスクトップアプリも更新されています。日本語化も完璧です。

今回の記事ではまず、新しくなったComfyUIデスクトップアプリについて紹介します。

https://www.comfy.org/download

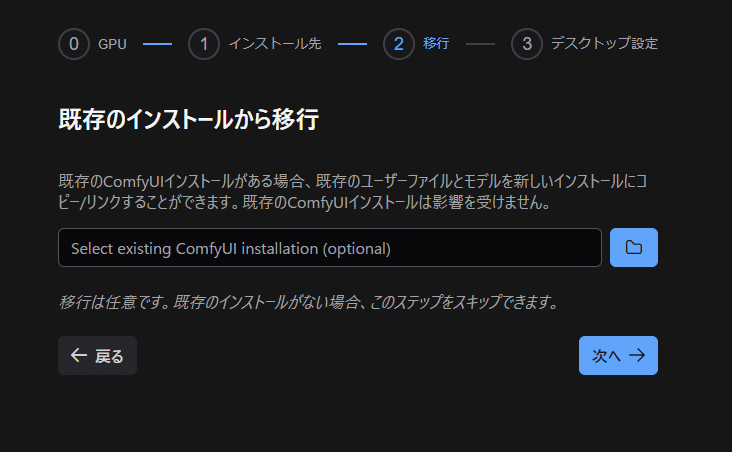

既存の「V1」のユーザーは移行ステップがあります。

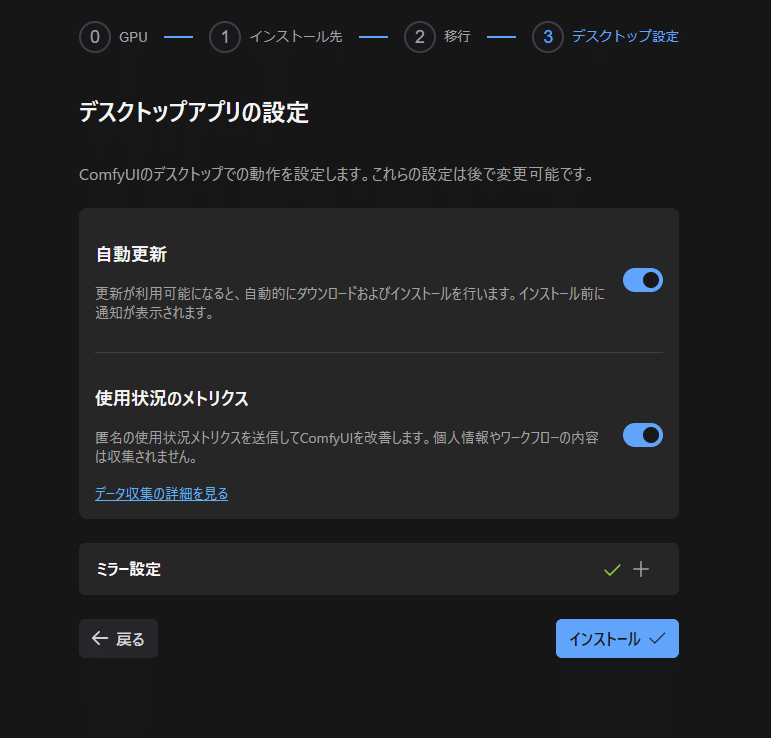

デスクトップアプリの自動更新や使用状況の提供を同意します。

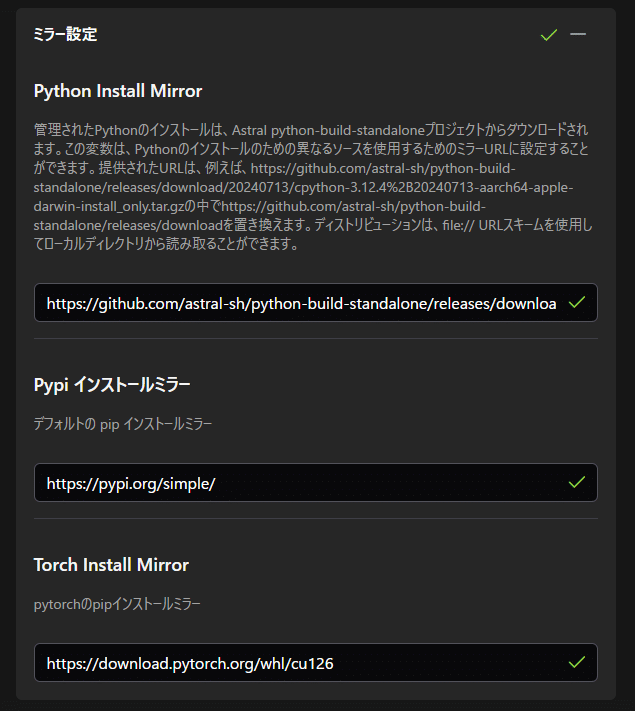

「ミラー設定」というPythonの設定をします。

何も考えずにインストールしてPython環境を破壊することもありませんね!

Wanのセットアップは次回に行っていきます。

VRAMとストレージに余裕が有る方は、ダウンロードを開始しておきましょう。

以下の4つのファイルをダウンロードします。

①拡散モデルから1つ選択 → `ComfyUI/models/diffusion_models` に配置

https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/tree/main/split_files/diffusion_models

以下の4つの動画生成モデルがリリースされています。

Text-to-video 14B: 480Pと720Pの両方に対応

Image-to-video 14B 720P: 720Pに対応

Image-to-video 14B 480P: 480Pに対応

Text-to-video 1.3B: 480Pに対応

14B(140億パラメータ) 40GB VRAM で 高品質 720p動画

1.3B(13億パラメータ) 15GB VRAM

とのことです。

RTX4090等、15GB以上のVRAMを搭載している方は1.3B をダウンロードしておきましょう。

※Google Colab環境の方は次の機会に解説します。

②umt5_xxl_fp8_e4m3fn_scaled.safetensors → ComfyUI/models/text_encoders に配置

https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/main/split_files/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensors?download=true

③clip_vision_h.safetensors → ComfyUI/models/clip_vision に配置

https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/main/split_files/clip_vision/clip_vision_h.safetensors?download=true

④wan_2.1_vae.safetensors → ComfyUI/models/vae に配置

https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/main/split_files/vae/wan_2.1_vae.safetensors?download=true

サンプルワークフロー

公式サンプル動画をクリックして、ComfyUI上にドロップすることで実際に試してみることができます。

720pの動画は迫力です

https://comfyanonymous.github.io/ComfyUI_examples/wan/image_to_video_wan_720p_example.webp

ついに動画もオープンモデルの時代がやってきました。

あなたもWan2.1で創造力を爆発させましょう!

Wan2.1のImage To Video、動き始めました~! pic.twitter.com/vWUE8INJuf

— AICU 「つくる人をつくる」クリエイターのためのAIメディア (@AICUai) March 1, 2025

続きはこちらです

#生成AI #動画生成AI #ComfyUI #Wan2 #AI動画生成 #テキストから動画 #画像から動画 #動画編集 #テキスト生成 #VAE #AI #機械学習 #深層学習 #StableDiffusion #拡散モデル