AIを利用したイラスト作成!OPENPOSE&自動着色&3Dで描いてみる

こんにちは。一般イラストレーターです。ControlNetが登場して以来、AI画像のポーズ指定や自動着色の話題を多く見かけるようになりました。私も前回は試さなかった自動着色を最近何度か触ってみて、イラストなどに取り入れを試みています。

今回は私なりのAIを利用した製作ワークフローをご紹介しつつ、便利な部分と「うーん、これはちょっとダメなのでは?」という部分も挙げたいと思います。

じゃあ少女と戦車でミリタリーな感じのイラストを描いていくぞい。

まずはアタリ作業です。openposeによるポーズ指定が可能になったので、「AIでイラスト作るならまずopenposeじゃないのん?」と思うところですが、3D空間でopenpose用3Dモデルなどを使用して脳内イメージ通りの構図を再現するのは案外難しいです。視点が硬化してイラスト的な構図やパースが損なわれがちですし、描きたいキャラと3Dモデルの身体バランスが違っていたら使えません。3Dポージングにも何分か時間がかかることを考えると、5分くらいでビャッと適当描きした方が楽ですね。

アタリ画像を切り出して、それを元にopenpose用画像を「手描き」します。画像を拡大してもらうと分かりますが、真ん中のopenpose用画像はクッソ適当で線もズレまくっています。こんなんで機能するんでしょうか?するんです。openposeは「大体この辺に人体があるらしいよ」以上の情報をAIに伝えていないので、配色すらもクッソ雑で機能します。

openpose用画像が用意できたら、それを併用しつつアタリ画像でi2iします。openposeで補助しているので、単にi2iするよりも姿勢がイメージ通りになっていますね。生成には私の絵柄で学習されたLORAを使用しています。

あと作業時の効率性を考えると、AIに読ませる画像は64の倍数ピクセルに揃えた方が良いです。それ以外だと生成時にリサイズやカットアウトされてしまうので、イラストツールにAI画像を持ってくる際に調整が面倒です。

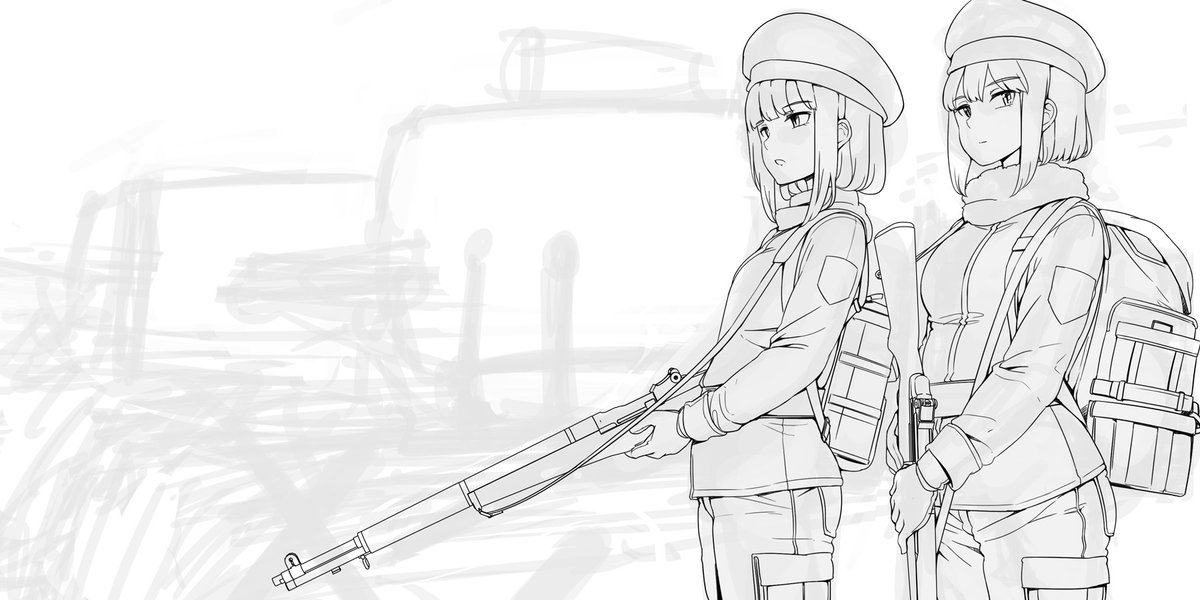

今度はこのAI画像を手描きトレスして線画を作成します。線画の自動抽出などもありますが、例によってAI絵は細部破綻しており、「このベルトは何処に繋がってるんだい??」的な謎構造まみれです。これを線画抽出して破綻している部分だけ直していこうにも、修正部と非修正部で線の質感にムラが出てしまったりと問題が多いです。なので線画は1から手描きトレスしてしまう方がトータルでは早く済みますね。

線画完了!1時間!

流石にトレス元があると早いのだ。デザインも整合性あるように変更。銃はフリー配布の3Dです。AI絵トレスの際に気を付けるべきことは、良い感じの絵に見えても人体バランスがとんでもなく狂ってる場合があることでしょうか。よく考えずに狂ったものをトレスしてしまいかねないので、バランスについては常に気を付けたいところです。

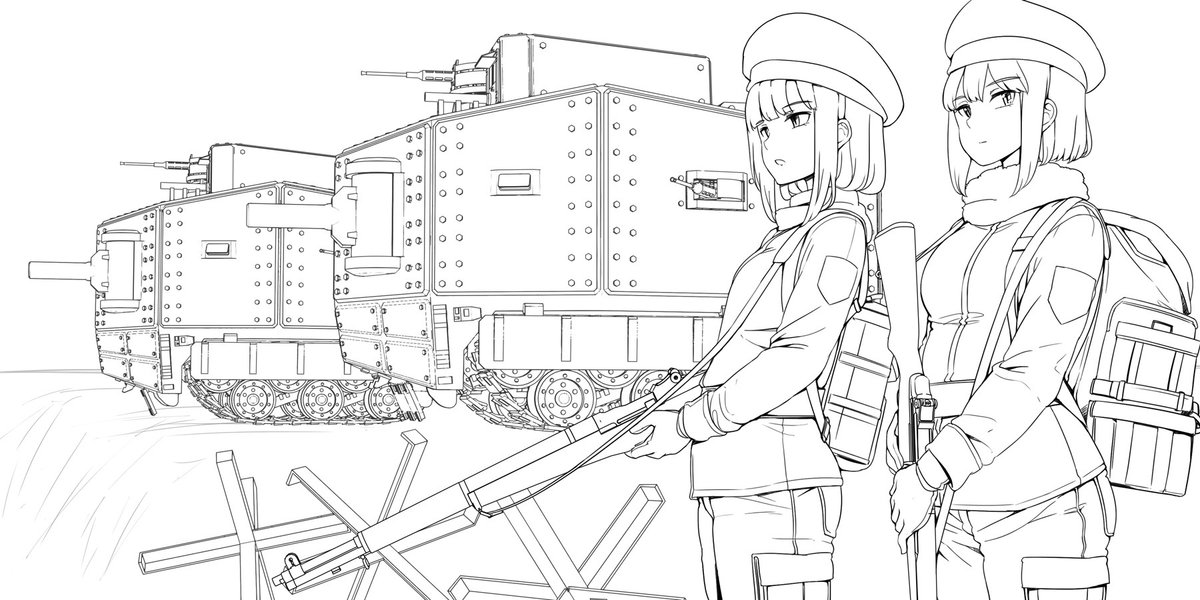

次は背景線画ですが、なんか作って遊んでた3D戦車があるのでそれを使用します。

現在のAIは有機物や服の皺など「正解の形」が無いものは良い感じに生成してくれますが、銃やメカなど正確で規則的な構造が不可欠なものは再現が難しいです。銃モデルとかメカモデルはあるにはあるけど結局細部は狂ってるし。特に同一形状のメカを二つ並べたり、装甲の表面に規則的なリベットを並べたりは、生成が不可能な部分ですね。

レンダリングした3D線画をちょっと修正!10分!

こういった構造物の作画には3Dがクッソ楽です。blenderは基礎色や影やハイライトやエッジの線をレイヤー分けしてレンダリングできるので、今回も何種かレンダリングしておいて背景作成時に使用していきます。同人屋もblender覚えると便利なんじゃ。

では線画もできたので、いよいよ自動着色をしていきましょう。

自動着色にはscribbleを使用。cannyのscribble modeでも自動着色できますが、どうも塗りの傾向に違いがあるようです。私はscribbleでやる方がスムーズなように感じました。

最低限のカラーリングをしたベース画像をi2iにセットして、controlnetには線画をセットします。キャラクターは背景に合ったライティングで着色してもらいたいですが、キャラクターだけ先に着色すると、最終的に背景と合成した際に色味がチグハグになって違和感が出てしまいます。なので自動着色の段階で、ある程度ライティングが塗れてる背景がある方が良いでしょう。こういうのはイラスト作業として癖がありますね。

何十枚か生成して良い感じのを選びます。良い感じですが、ディティールが違ってるし表情もなんか発情してますね。先ほどの線画に生成画像を当て嵌めてみよう。

うーん、全然合っていない…。正直この部分がバッチリ合ってくれないと「細部が適当で良いなら使える」の域を出られないと思うんじゃが。『自動着色』とは言いますが、実際にはAIが取得したアウトラインからそれっぽい絵を描き直しているだけなのです。この辺の精度はcannyのscribble modeも同じでした。着色された生成物にも修正が必須でしょう。

修正完了!1時間40分!

細部まで完璧に整えるとやはり結構時間かかりますね。AI生成画像と手描き線画を合わせる場合、生成画像に描かれている主線部分と、私が描いた主線が重複して線にムラが出てしまうのが問題の一つです。頑張って良い感じに修正するしかない。

今回はAI利用方法の紹介なのでキャラクターに対する自動着色をおこなっていますが、細部修正の手間やカラーリングや後のライティング調整のし易さを考えると、キャラクターは手塗りしたいのが正直なところです。

キャラができたので続いて背景作業。戦車は自分でやろうと思っているのですが、一応AIに自動着色させるとどんな感じになるか試してみましょうか。

形状が全然変わっちゃってるのだ。やはり精密な構造物の生成には不向きっぽい。真面目に手作業すっぺ。

加筆して遠景もAIに描き直させてキャラを色調調整して1時間。大体よし。

キャラクターが浮いてしまっていたので、色調を調整して良い感じのモヤモヤも描き加えました。前の工程で背景色と一緒に自動着色して背景との差異を抑えたつもりだったけど、やはり違和感が出てしまいましたね。統合された一枚画像はこういった後からの色調調整が難しいのがネックです。画像をレイヤー分けしてくれるAIがつい先日出て来たみたいですが、まだ試してないけど多分アレ細部修正がレイヤー毎に必要になって手間が倍増してるんじゃないか。

そろそろ完成しそうです。最後に背景にモブを何人か追加したいのでopenposeを使います。

モブが生成できました。背景モブ生成用にopenpose画像集を持っておくとこういう時に捗りますね。私もopenpose弄って良い感じのポーズが出来た時は保存しております。

残念ながらモブたちはまだ「遠くから見ると人間っぽいシルエットで生存者を騙して誘き寄せるタイプのバケモン」なのでチマチマと細部修正していきます。最終的な調整もして所要時間1時間!

完成!合計3時間50分!

はい、完成しました。約四時間でこれは結構早いぜ。まぁAI生成作業の部分では設定を見直したり試行錯誤したり合間でちょいちょい20分30分と取られていますので、実際の作業時間はもっと長いです。3Dモデルの配置やレンダリングにも時間はかかるし、ていうか今回はAI云々より3D作画による作業短縮の面も大きいし。

■自動着色はAIが描きたくないジャンルは筆がノらない?

実はキャラクターの自動着色の際、明らかに低品質な画像が生成されてしまい、途中で作業がしばらく頓挫しました。色々試してみたところ、どうやら自動着色でもAIモデルが学習していない内容は生成の質が下がってしまうようです。

取り急ぎ線画を描いて検証。プロンプトは「ライフルを持った軍服の少女」を「制服を着た少女」に変えているだけなのですが、デカパイセーラー服の方は塗りが良い感じなのに対し、軍服だと何故か簡単塗りや影が全くついていない低品質なものばかり生成されてしまいました。恐らく露出の少ないモコモコした服装の学習量が少ないか、低品質な画像と関連付けて学習してしまっているんでしょう。一応、軍服絵の方をハイクオリティイラストっぽいプロンプトで修飾したり「制服の少女!」と言い張ってみたりもしましたが、あまり改善は見られませんでした。

別モデルではスムーズに生成できたのですが、軍服が下手なモデルは私の絵柄を生成するのには適しているので困りものです。この問題は軍服に限らず、キャラクターの姿勢や背景でも起こり得るでしょう。以前の記事ではAIの得意分野に合わせてモデルを切り替えて画像作成していましたが、あれはあくまで「実写」という作画の枠内でやっていたものです。イラストの場合、作画の違いは大きいので、何か描いてる途中で生成できないものにブチ当たるたびにモデルやLORAを変えてたんじゃ作品がガタガタになるのだ。

アタリ画像とopenposeで生成したAI画像をトレスする手法は、素早い線画作業ができるので使えると思います。また、下書きから大まかな完成予想図を何パターンも生成してライティングやコスチュームを検証できるのは、真っ当なお絵描きの役に立ちます。ただ自動着色などは生成の安定性の問題があり細部修正にも割と時間がかかりますので、作画ツールとして真面目に取り入れるにはちょっとクセが強いですね。

では今回は以上です。

■関係ないけどAIホラー創作どうぞ

Under the Hole (1/4) #stablediffusion #b3d pic.twitter.com/Hj0fvOWMvo

— あぶぶ@健全 (@abubu_newnanka) February 11, 2023