YTPMVとか音MADにおける原型の残し方

YTPMVとか音MADを作っておりますきゅうと申します。みなさんが好きな素材を音程合わせに使ったら原型が消えてしまいなんやねんとなった経験あると思います。自分なりに色々試したことを書いていきます!

⚠️注意⚠️

このnoteでは原型を残すことについてギャーギャー説明しますが、いわゆるシンセ化などによって原型がなくなることは悪いことだとは思ってないです。どっちにするかそこは自分で決めていい感じに使い分けましょう

最初にすごい当たり前のことを言うんですけど、加工すればするほど原型はなくなります。素材の原型を残したいとなれば、できるだけ加工する数をへらすことが大切です。すごい当たり前なんですけどこの気持ちを大事にです

あとは、結構この記事では人の声を素材にしたときのことを書いてます 注意

まずは、素材選びから!

悲しいことに素材選びから気を付けないといかんです。

そのパートの音程と近い音程の素材を選ぶ

ピッチをあげすぎたり、さげすぎたりするといかんということです。

高い音の素材をむりやりベースにつかったりすると、めちゃめちゃピッチをさげないといかんのでそりゃ原型はなくなります。

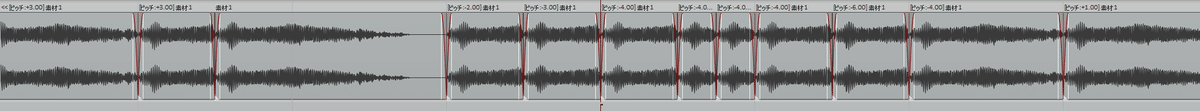

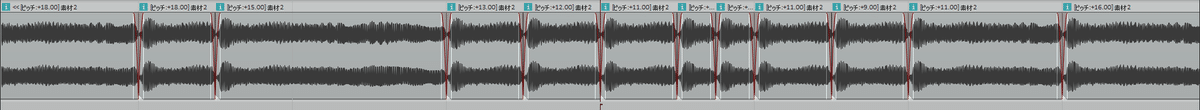

音程合わせしたときにピッチの変更がだいたい-5~+5ぐらいになるぐらい原曲の音程と素材の音程が似てたらまあまあまあまあまあよっぽど意味わからん音にはならないと思います でもちゃんとキーは合わせてね!

すみません字ちっさいので拡大して見てください↓

特徴的で人間らしい声の素材を選ぶ

特徴的な素材はつよいので、結構加工しても"味"がします。

おもしろい声、珍しい声など…

この話はあとでもっと話します。

原型を残す工夫

実際に作っていく!ときに気をつけるポイントとなります

Vocalshifterでの加工はやりすぎに気を付ける

音MADの作り方動画とか見るとVocalShifterで音程を平均化してその後母音の部分を何倍にも引き伸ばす…といった感じの手順が出てきますが本気で原型を残したい場合はやめたほうがいいです。私はピッチがほぼ変わらない素材はそのまま加工せずに使いますしそうじゃない素材でもピッチのある程度の平均化はこんな感じでReaperのピッチベンドで私は最近合わせてます。なんでこんなことしてんのという理由はまた後で話します 引き伸ばしに関しても素材の長さが足りないときだけ、足りない分だけ伸ばす、というのがいいね

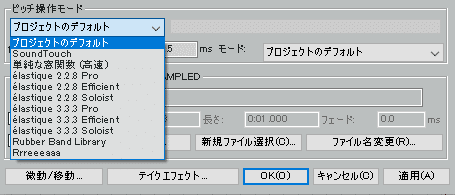

ピッチ操作モードを変える

Reaperで音声アイテムをダブルクリックするとこんな画面が出てきます。

ピッチを変えたアイテムのここをelastique 3.3.3 Soloist - 単声とかelastique 3.3.3 Pro - フォルマント補正(汎用)とかにすると自然な声になると思います。その時々に使い分けましょう!

エフェクトはほどほどに!

さっきも言った通り、加工すればするほど原型はなくなります。エフェクトをギャンギャンギャンギャンかけたらいかんです。あと色々かけすぎて音圧バチコーンあげてまうと他のパートとぶつかって両方聞こえにくくなるというリスクもあるのでそんなめっちゃきつくVSTかけないというのは大事になります

こんな感じに色々書きましたが、結構当たり前のことばっかり書いてて知っとるわと思われてるかも でもちゃんと1個1個しっかりやることが大事なんとちゃうかなあと私は思います あと別にこの中で1つでも守らなかったら一発で原型が崩壊する…というわけではないです。完全に加工してない状態を原型ポイント100として何か加工するたびにそれが減っていき、それをあなたがどこまで許すかという話。これを全部完璧に守るのはなかなかできないので、流石に加工やりすぎかと思ったら止める、っていうその感じでいいです。

それぞれのパートを目立たせる

YTPMVとか作る場合はたくさん音重ねるのでそれぞれのパート単体で聴くと全部原型のこってるのに、全部合わせて聞くとどうしても「原型残ってる感」が目立たないパートがあります。それぞれのパートが分かれてそれぞれ聞こえるようにする方法を紹介します。

イコライザーで帯域を分ける

音の周波数の帯域が被ってると両方まざって両方目立たなくなります 分けましょう。

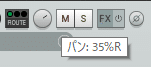

パンをふる

一番単純ですが効果あります。4和音のコードのうち2音は左に、2音は右にとかやってもいいですね

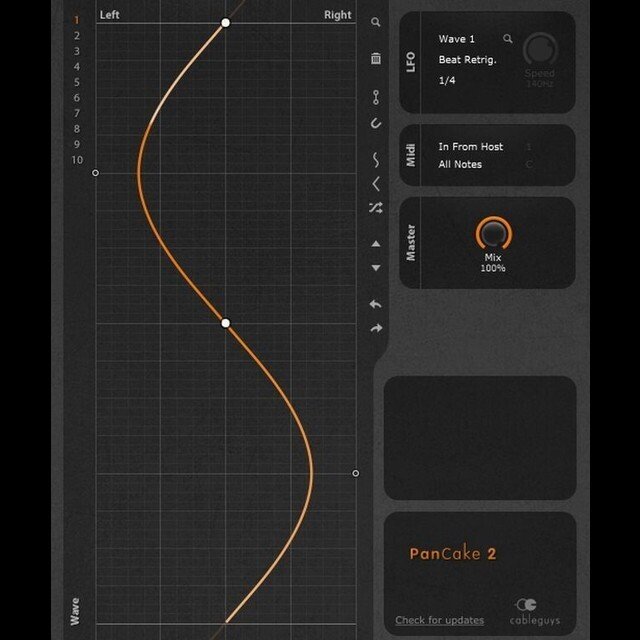

あとはPancake2などのプラグインをかけたりしてもいいですね

コーラス、リバーブなどで音を広げる

VSTプラグインなどを使ってコードなどの音を広げましょう モノラルのパートとステレオ感のあるパートを作るといい感じに分かれて聞こえるようになります

ハース効果を使う

右と左で音の鳴るタイミングをちょっとだけずらすというものです

私はKiloheartsのHaasというVSTをつかっております コーラス、リバーブとはまた違った広がり方をします 試してみてね

正直ここはおれもべらべら喋れるほど詳しくないので他のちゃんとした人のちゃんとした記事を読むのもいいね

音の「人間らしさ」について

愛しのキャラの声の原型を残したいのになんか機械音みたいになってしまう!という経験みなさんあるよねー ここで機械っぽい音の特徴と人間っぽい音の特徴を自分なりに考えて書き出してみました。

機械っぽい音

ピッチにズレがない

変化がない

子音とか息の音とかがない

人間が出せないぐらい音が高いまたは低い

人間っぽい音

ピッチに多少ズレがある

息の出方とか音量とかいろいろ変化がある

子音とか息の音とかあるし母音も途中で変わったりするときもある

人間が出せる音域

機械音っぽくなってる場合は、これらの人間っぽい音の条件から外れてる場合が多いのではないかと思います。特に1と2の特徴はVocalshifterでの作業で失われている場合が多いと思います

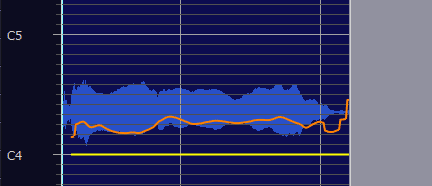

まず1 音MADの作り方動画みたいなのでこんな感じで音程を平均化しちゃいましょうという指示をよく見かけます

これをすることによって音程のズレが完璧になくなります 音程合わせはしやすくなるかもしれないですが、人間は完璧な生き物ではないのでこんなに100%音程が合い続けている声は出せません だから音程を平均化した素材を音程合わせすると機械っぽいなあという感想になるわけです 歌がめっちゃうまい人もしゃくりやビブラートなど音程を少しずらすというテクニックを使ったりするので音程が100%合っている=良いというわけではないです。多少のズレを感じ取って人間は人間らしさを感じるのでありますわ 私が上で説明したReaperのピッチベンドで合わせるやり方は、完璧にではなく大雑把にだいたい音程を合わせるという目的でやってます(あとVocalShifterをわざわざ起動してReaperとこう何回もソフトを行き来するのが、めんどくさい☆)あとは音程合わせをした後に音が伸びる部分にだけ個別にビブラートをかけたり、ピッチエンベロープを細かく書くとかそういうのも人間っぽくするために有効です。2号兄貴の表情をつけられた歌声.mp4とかguitar.mp4を見なさい わかりやすいから

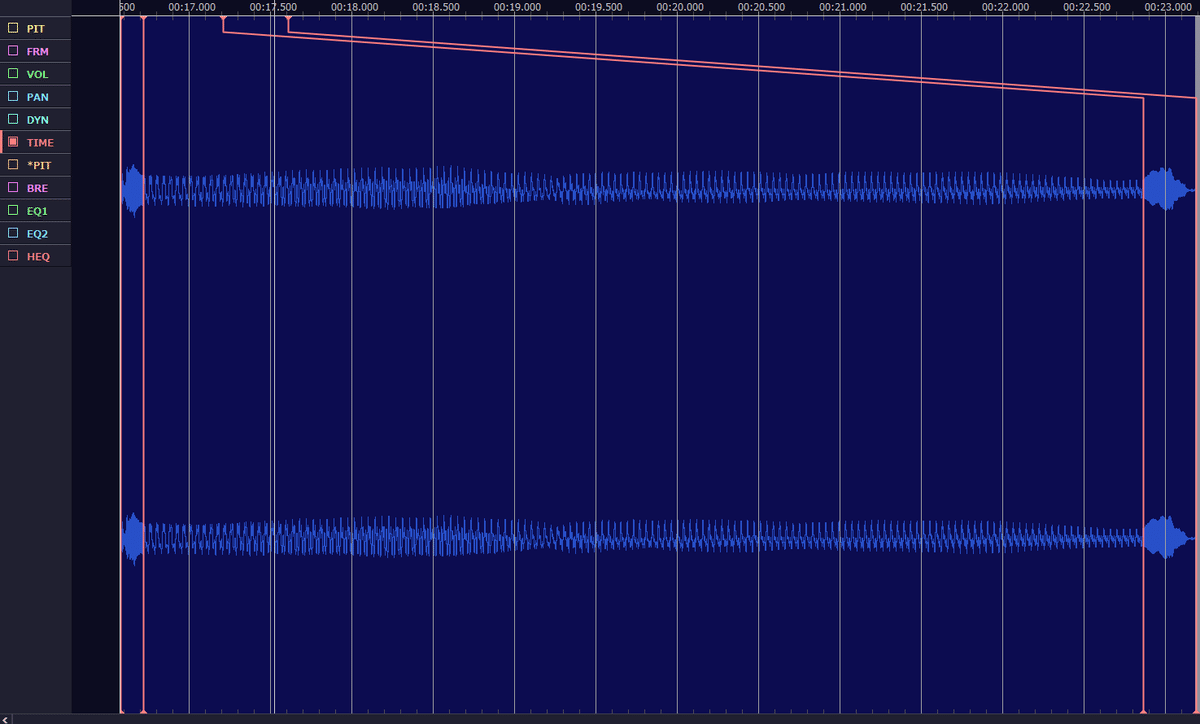

次に2 音MADの作り方動画みたいなのでこんな感じで引き伸ばしちゃいましょうという指示をよく見かけます

これをすることによって音が長くなって途中で音が切れちゃうということがなくなります でも、引き伸ばしたことにより声の性質とか音量とかが変化する時間も引き伸ばされ最初のほうだけ再生するともうほぼ変化がないように聞こえます 人間は完璧な生き物ではないのでこんなに変化がない声は出せません だからVocalShifterで何倍にも引き伸ばした素材を音程合わせすると機械っぽいなあという感想になるわけです 多少のズレを感じ取って人間は人間らしさを感じるのでありますわ 音の長さが足りないときだけ引き伸ばして使う、そして引き伸ばさなそんなんすぐ長さが足りなくなるぐらいのもうほんまピッってそんな短い音しか鳴ってないようなそんなほんまもうようわからん素材は使わないという判断も大事です あと発音が終わる瞬間ってのも人間らしさ発揮ポイントなのでそこしっかり使うといいね

そして3 これはもう簡単です音程合わせするときに子音をカットせず使うということです だーって言っとる素材があったらちゃんとDa-のDの部分が人間らしさをもってるのでそこカットしないでというはなし

あと、あいーとかでゅわーとか言ってる素材あったらそれは母音が途中で変わるのでめっちゃ人間っぽいです原型残りやすいです 機械音が途中で母音かわるなんかほぼないです 私たち人間の特権 フゥー

さいごに

どうでしたか?一応私も色々試してる途中なので全然間違ってることあるかもしらんしそこはまあまあまあまあまあまあまあまあもう許してください。

あと素材選びのこといろいろ書きましたけど素材選びには原型が残りやすいか以外にも大事な判断基準がいっぱいあります写ってるキャラクターがかわいいとかいろいろそれはそれぞれ 原型残すこと難しいし大事やとは思うんですけどまあそんな原型のことばっかり考えすぎて作らんでもいいのかなーと思うんでこの記事のことはまあ一応頭においとく程度でいいと思います

あとUTAUとかRVC使った音程合わせについてもまた色々試したいんですけどそれはまだやってないのでやったらまた書きます

それではよい音声つくりまくりライフを…